24.1 端到端自动驾驶

自动驾驶是大模型在物理世界中最具挑战性的应用之一。与对话生成、图像识别等"纯数字"任务不同,自动驾驶系统的输出直接作用于真实世界——一次错误的转向决策可能导致不可逆的后果。正因如此,自动驾驶领域对模型的安全性、实时性和泛化能力提出了极高要求,也成为检验大模型工程化落地能力的"试金石"。

本节将系统梳理端到端自动驾驶(End-to-End Autonomous Driving)的技术演进脉络:首先回顾自动驾驶的等级划分与传统模块化架构,理解端到端范式提出的背景;然后深入剖析从 BEV 感知到 Occupancy Network 的关键技术组件;接着解读 UniAD、GenAD、DriveVLM 等代表性端到端算法的设计思想;最后讨论端到端自动驾驶面临的核心挑战与技术路线之争。

24.1.1 自动驾驶等级与传统模块化架构

自动驾驶的六个等级

国际汽车工程师学会(SAE International)将自动驾驶分为 L0 至 L5 六个等级,从完全依赖人类驾驶到完全无需人类干预,形成了一个渐进的技术阶梯:

图 24-1:自动驾驶的六个等级(L0-L5)。L0-L2 为辅助驾驶,驾驶员始终是操控主体;L3 为有条件的自动驾驶,在特定场景下可由系统接管;L4 在绝大多数场景下实现自动驾驶,不需要人类干预;L5 在任何场景下均可自动驾驶。

目前国内大多数量产车企的智能驾驶处于 L2 至 L2+ 水平,驾驶员仍不可或缺。百度萝卜快跑在武汉实现的无人驾驶运营服务已达到 L4 级别,即在限定运营区域(ODD,Operational Design Domain)内无需安全员。而 L5 级别——在任意场景下完全自动驾驶——至今仍是整个行业的终极目标。

不同等级的自动驾驶对硬件传感器的要求也截然不同。以百度 Apollo RT6(萝卜快跑使用的车型)为例,配备了 8 个激光雷达、12 个摄像头、6 个毫米波雷达和 12 个超声波传感器,计算平台算力达到 1200 TOPS,并拥有电源、通讯、制动、转向、架构、计算单元和传感器七重冗余。而特斯拉则走了截然不同的路线——从 HW4.0 开始仅依赖 12 个摄像头(纯视觉方案),完全去除了激光雷达。这两种硬件哲学的对立也折射出端到端自动驾驶技术路线的分歧:多传感器融合追求的是感知冗余和安全性,纯视觉方案追求的是成本可控和规模化部署。

传统模块化架构:级联流水线

在端到端方案出现之前,自动驾驶系统普遍采用模块化级联架构(Modular Pipeline),将整个驾驶任务拆分为多个独立的功能模块,按照流水线方式串联执行:

- 高精地图(HD Mapping):提供车道线、交通标志等静态环境信息

- 感知(Perception):检测周围的车辆、行人、障碍物等动态对象

- 定位(Localization):确定自车在地图中的精确位置

- 目标跟踪(Tracking):持续追踪感知到的动态目标的运动状态

- 行为预测(Prediction):预测周围交通参与者的未来轨迹

- 路径规划(Path Planning):为自车规划一条安全、合理的行驶路径

- 决策(Decision Making):在多种可选策略中做出最优驾驶决策

- 控制(Controls):将规划结果转化为方向盘角度、油门、刹车等执行指令

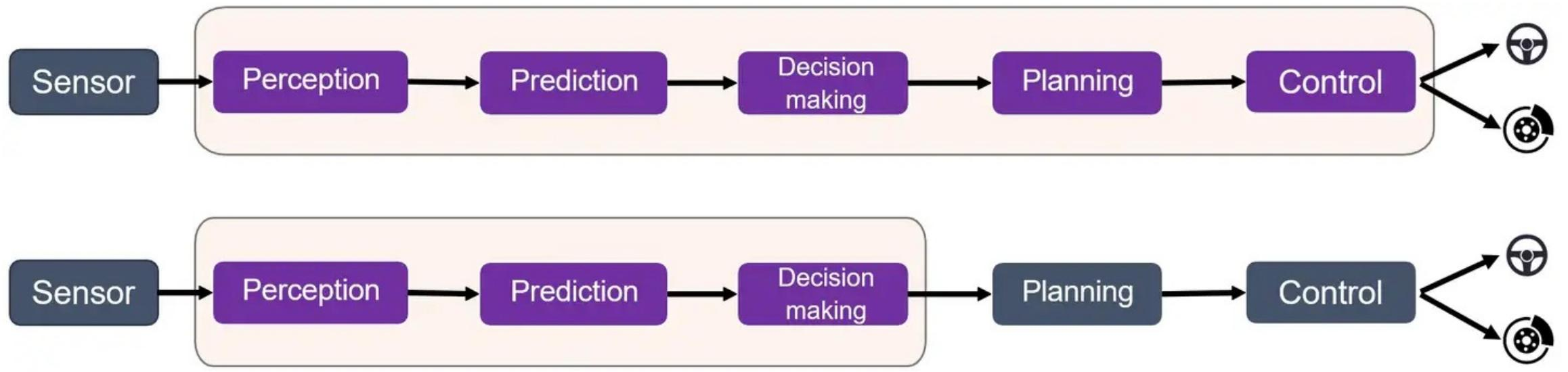

图 24-2:级联式与端到端式的架构对比。上方为传统级联架构——所有模块被统一网络包裹但仍有独立边界;下方展示了逐步解耦感知-规划边界的端到端思路。

这种模块化设计的优势在于可解释性强——每个模块的输入输出都有明确的物理语义,工程师可以独立调试和优化。但它也面临两个根本性问题:

- 级联误差累积:每个模块的输出是下一模块的输入。如果感知模块漏检了一辆车,后续的预测、规划模块会基于错误的信息做出决策,误差沿流水线逐级放大。

- 信息损失:模块之间通过"中间表示"(如 3D bounding box、轨迹点)传递信息,这些离散化表示不可避免地丢失了原始传感器数据中的丰富信息。例如,感知模块输出的目标检测框无法保留目标的纹理细节、遮挡关系等对规划有价值的信息。

此外,每个模块都需要独立训练和维护,整个系统无法进行全局优化——各模块分别优化各自的损失函数,但模块间的最优不等于系统全局最优。

24.1.2 端到端自动驾驶的核心思想

什么是端到端?

端到端自动驾驶(End-to-End Autonomous Driving, E2E AD)的核心理念是:用一个统一的神经网络模型取代传统的多模块级联流水线,直接从传感器输入(摄像头图像、LiDAR 点云等)映射到车辆控制输出(方向盘角度、加速/制动等)。

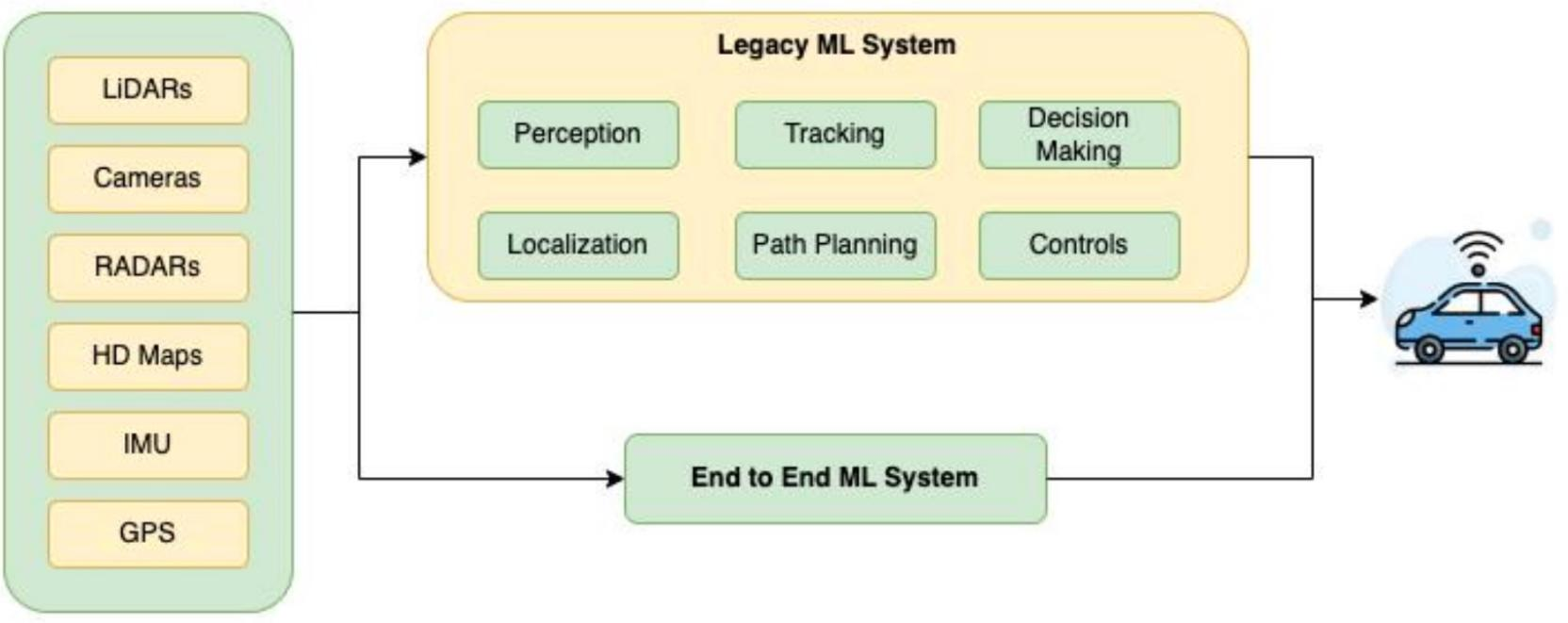

图 24-3:模块化系统与端到端系统的对比。传统 ML 系统(上方)将感知、跟踪、定位、路径规划、决策、控制拆分为独立模块;端到端 ML 系统(下方)用单一模型直接从传感器输入到控制输出。

需要特别澄清三个经常被混淆的概念:

- 端到端自动驾驶:强调从传感器到控制的全流程由可微分网络连接,实现全局优化

- 大模型自动驾驶:使用大语言模型或大视觉模型来辅助自动驾驶决策

- 纯视觉自动驾驶:仅使用摄像头(不用 LiDAR 或雷达)作为感知输入

这三者之间存在交集但不等同。端到端系统不一定依赖大模型,也不一定采用纯视觉输入;反之,使用大模型的系统也可能只负责部分决策环节而非全流程端到端。

从"严格定义"到"宽泛定义"

端到端自动驾驶的定义本身经历了演变:

- 早期严格定义:从传感器输入到控制输出的单一神经网络模型,中间没有任何手工规则介入。NVIDIA 在 2016 年发表的 DAVE-2 系统是这一定义的典型代表——一个 CNN 直接从前置摄像头图像预测方向盘角度。

- 现阶段宽泛定义:感知信息无损传递,自动驾驶系统的全局优化。允许模型内部存在多个功能子网络(如感知子网络、规划子网络),只要它们通过可微分连接实现联合训练和梯度传播,就算作端到端。

后者是目前业界和学术界的主流共识。特斯拉 FSD V12 在切换到端到端架构后,代码量据称从 30 万行缩减到约 2000 行——大量手工编写的规则被数据驱动的神经网络取代。

端到端 vs 级联:核心对比

| 维度 | 级联方案 | 端到端方案 |

|---|---|---|

| 算法类型 | 模型算法 + 规则判断 | 模型算法 + 数据驱动 |

| 安全性 | 高(规则兜底) | 待验证 |

| 可解释性 | 高 | 低 |

| 累计误差 | 高(级联放大) | 无(全局优化) |

| 研发模式 | 各模块独立迭代 | 统一模型端到端训练 |

| 数据依赖 | 中等 | 极高(需海量驾驶数据) |

| 算力需求 | 中等 | 高 |

24.1.3 关键技术组件

端到端自动驾驶虽然追求"一个模型搞定一切",但其内部架构并非简单的黑盒。现代端到端系统通常由几个关键技术组件协同工作。

BEV 感知:从透视图到鸟瞰图

BEV(Bird's Eye View,鸟瞰图)感知是近年来自动驾驶感知领域的核心技术。摄像头拍摄的图像是透视投影(Perspective View),物体的大小和距离关系会因视角而产生畸变。BEV 将多个摄像头的图像特征统一转换到俯视平面坐标系中,生成一张"从天空向下看"的特征地图——在这个表示中,车辆、车道线、障碍物的空间关系一目了然。

BEV 转换的关键技术包括:

- LSS(Lift, Splat, Shoot):通过显式预测每个像素的深度分布,将 2D 图像特征"提升"到 3D 空间,再"拍扁"到 BEV 平面。这种方法计算量大但几何精度高。

- 基于 Transformer 的 BEV 编码:使用可学习的 BEV Query 通过交叉注意力机制从多视角图像特征中聚合信息。BEVFormer 是这一路线的代表,它通过时空注意力同时编码当前帧和历史帧的信息,实现了时序一致的 BEV 表示。

BEV 表示的优势在于为后续的目标检测、轨迹预测和路径规划提供了统一的空间坐标系。这也是为什么几乎所有现代端到端方案都以 BEV 作为中间表示——它是连接感知与规划的"通用语言"。

从数学角度看,BEV 编码的核心是完成一次视角变换。以 BEVFormer 为例,设 BEV 平面上的 query 位置为

其中

Occupancy Network:三维栅格占用网络

Occupancy Network(占用网络)是特斯拉在 2022 年 AI Day 上首次系统展示的技术。与传统的 3D 目标检测(用 bounding box 描述物体)不同,Occupancy Network 将三维空间划分为密集的体素网格(Voxel Grid),对每个体素预测"是否被占用"以及"被什么类别占用"。

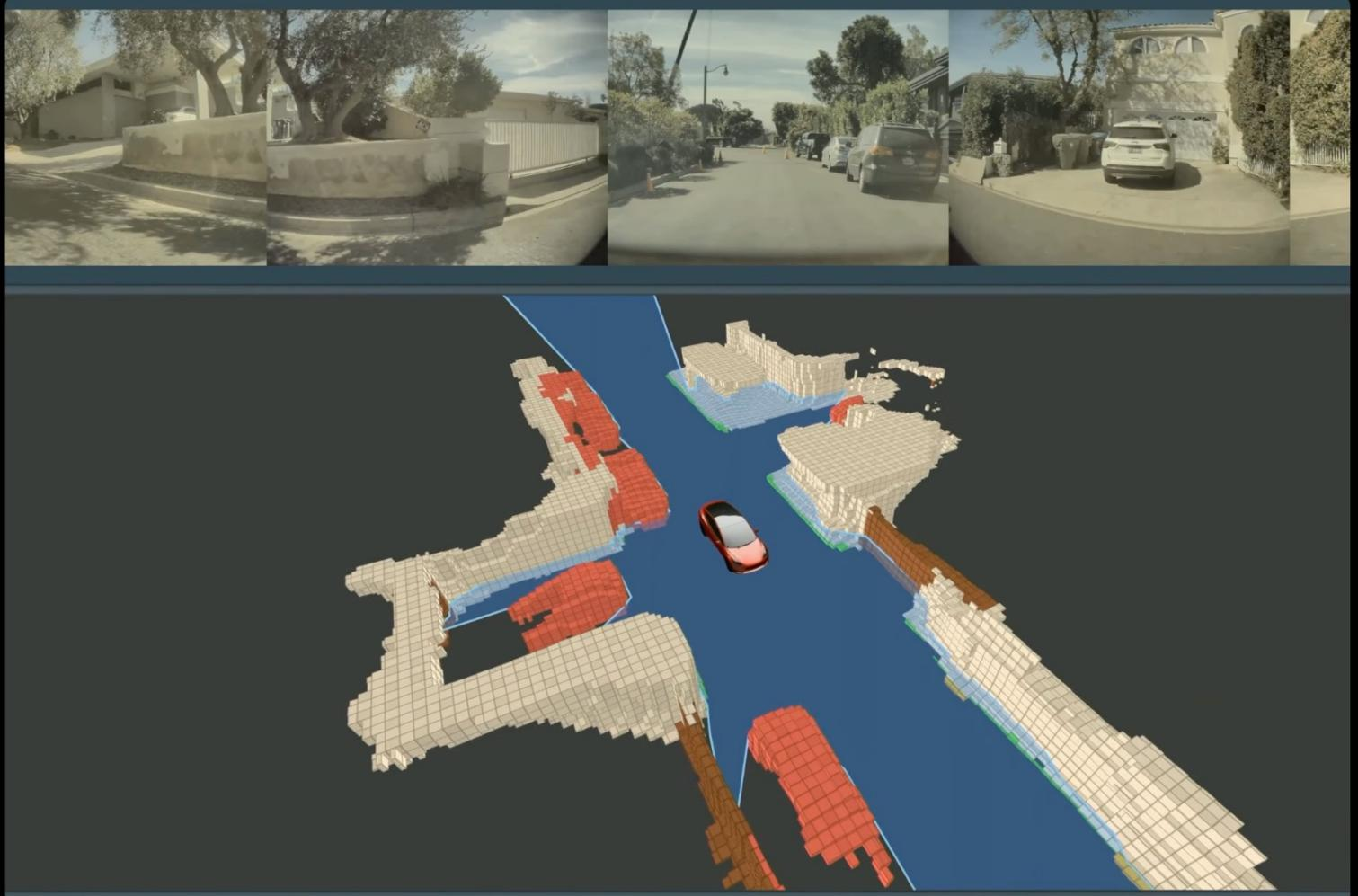

图 24-4:Occupancy Network 的可视化效果。上方为多摄像头输入图像,下方为模型输出的三维占用预测——用体素化方式重建了完整的三维场景,包括建筑物、车辆、道路等。

Occupancy Network 的核心优势:

- 无需预定义类别:传统目标检测只能识别训练集中见过的类别;Occupancy Network 预测的是"空间是否被占据",对于从未见过的异形障碍物(如掉落的货物、施工路障)同样有效。

- 处理遮挡:通过体素化表示,即使物体被部分遮挡,模型仍可根据上下文推断被遮挡区域的占用状态。

- 分辨率可调:可以在关键区域(如车辆前方近距离区域)使用更高分辨率的体素,在远处使用粗分辨率,兼顾精度和计算效率。

特斯拉声称其 Occupancy Network 在车载硬件上的推理时间约为 10 毫秒级别,满足实时性要求。

Vector Space 与路径规划

除了体素化的 Occupancy 表示,特斯拉 FSD 还引入了基于 Vector Space 的路径规划。其核心思想是 Interaction Search(交互搜索)——在向量化的场景表示中,搜索最有可能发生的交互场景(如"前车突然变道"、"行人横穿"),将有限的计算资源集中在最高概率的交互结果上("Focus Compute on the Most Promising Outcomes")。这种设计避免了对所有可能未来进行穷举搜索,在保持规划质量的同时显著降低了计算开销。

24.1.4 评测方法与代表性算法

开环与闭环评测

端到端自动驾驶的学术研究主要通过两种方式评估:

- 闭环评测(Closed-loop):在模拟器(如 CARLA)中让算法实际控制车辆并观测驾驶效果。算法输出的控制指令会被真实执行,车辆状态会相应改变,形成"动作→状态→观测→动作"的闭合回路。闭环评测能直接反映算法在真实驾驶中的表现,但模拟器的真实度和计算成本是主要瓶颈。

- 开环评测(Open-loop):在已采集的真实驾驶数据上,比较算法预测的轨迹与人类实际驾驶轨迹的差距。算法输出的指令不会被执行,也无法观测执行后的效果。

开环评测的常用指标包括:

- L2 距离:计算预测轨迹与真实轨迹在各时间步上的欧几里得距离,衡量轨迹精度

- Collision Rate(碰撞率):计算预测轨迹与其他交通参与者发生碰撞的概率,衡量轨迹安全性

不过,开环评测存在根本局限——预测误差(Prediction Error)并不等同于实际驾驶表现。一个在开环指标上表现优异的模型,在闭环中可能因为缺乏对自身动作后果的感知而表现不佳。因此,闭环评测被认为是更可靠的评价方式。

UniAD:以规划为导向的统一架构

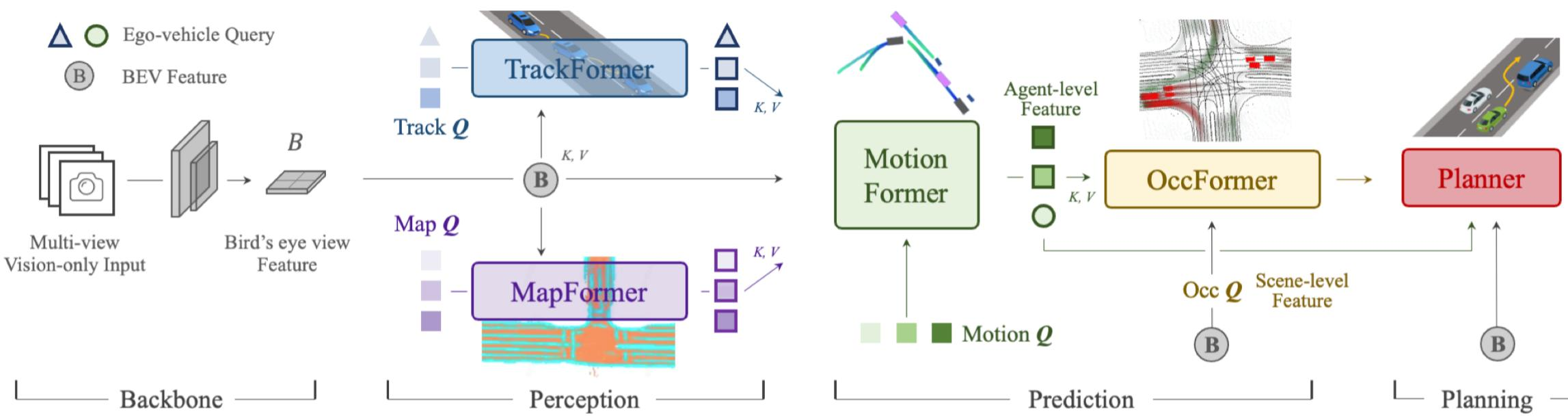

UniAD(Unified Autonomous Driving, Hu et al., 2023)获得了 CVPR 2023 Best Paper,它是第一个在单一网络中统一了感知、预测和规划三大任务的端到端系统。

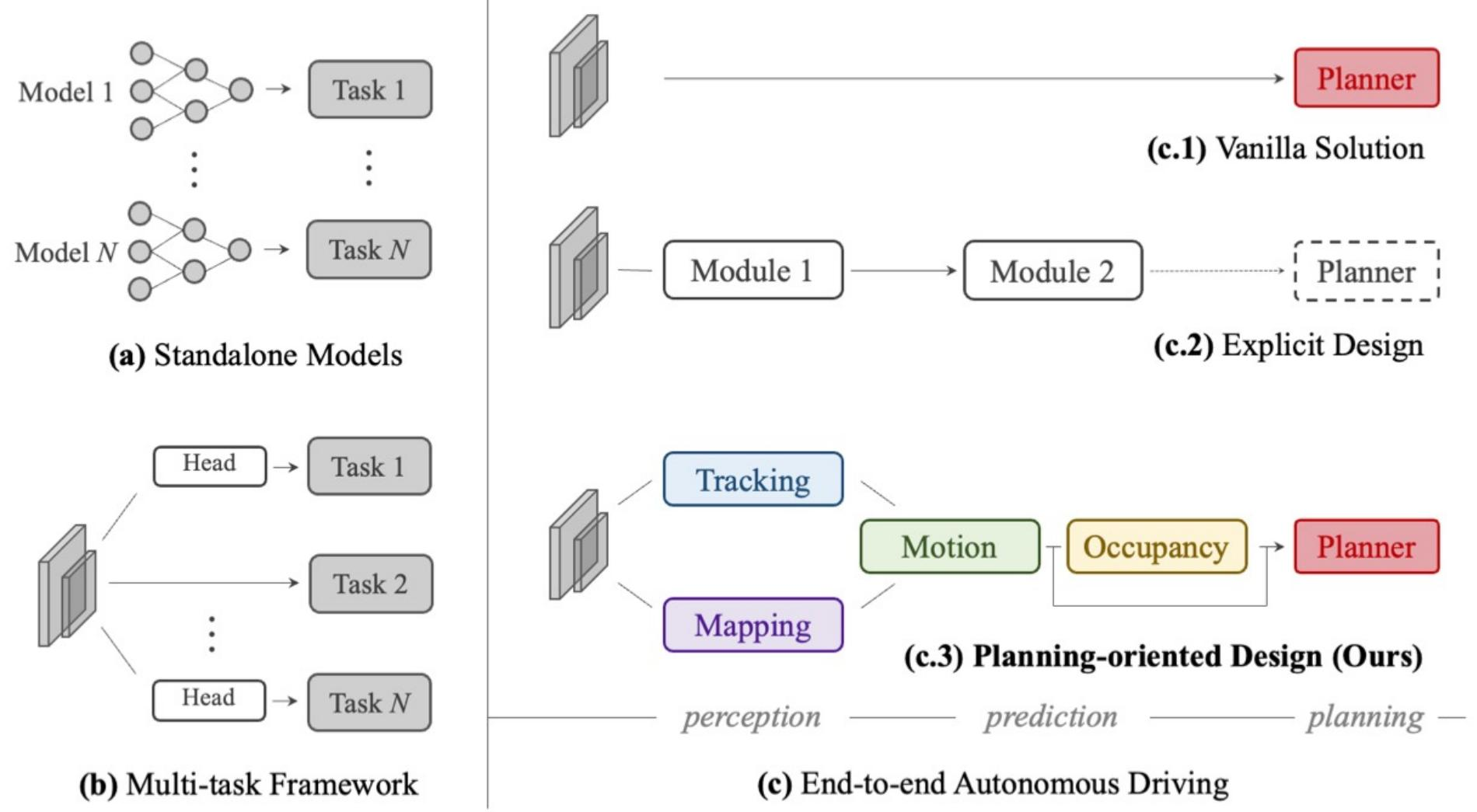

图 24-5:端到端自动驾驶的设计范式对比(来源:Hu et al., 2023)。(a) 传统的独立模型;(b) 多任务框架,共享 backbone 但任务头独立;(c) 端到端方案——(c.1) 直接输出规划、(c.2) 显式设计中间模块、(c.3) UniAD 的规划导向设计。

UniAD 的核心设计思想是 "Planning-oriented"(以规划为导向):所有感知和预测模块的设计都服务于最终的规划任务,而非独立地优化各自的指标。具体包含四个级联的 Transformer Decoder 模块:

- TrackFormer(感知):接收 BEV 特征,输出目标检测和跟踪结果

- MapFormer(感知):提取车道线、道路边界等地图元素

- MotionFormer(预测):预测所有交通参与者的未来运动轨迹

- OccFormer(预测):预测未来时刻的占用状态

- Planner(规划):综合以上所有信息,输出自车的规划轨迹

图 24-6:UniAD 的完整架构(来源:Hu et al., 2023)。多视角摄像头图像首先通过图像 backbone 提取特征,然后经 BEV 编码器获得鸟瞰图表示。各模块通过 Transformer Decoder 结构级联,以 task query 作为模块间的接口,最终输出规划轨迹。

UniAD 的关键创新在于模块间通过 task query 传递信息——每个模块输出的 query 特征直接作为下一模块的输入,保持了特征的连续性和可微性,使得规划损失可以反向传播到感知模块,实现真正的全局优化。

UniAD 的实验结果表明,联合训练带来了显著的性能提升:相比将各模块独立训练再串联的方案,联合端到端训练在 nuScenes 数据集上的规划指标(L2 距离、碰撞率)均有明显改善。这验证了"全局可微 + 规划导向"设计哲学的有效性。

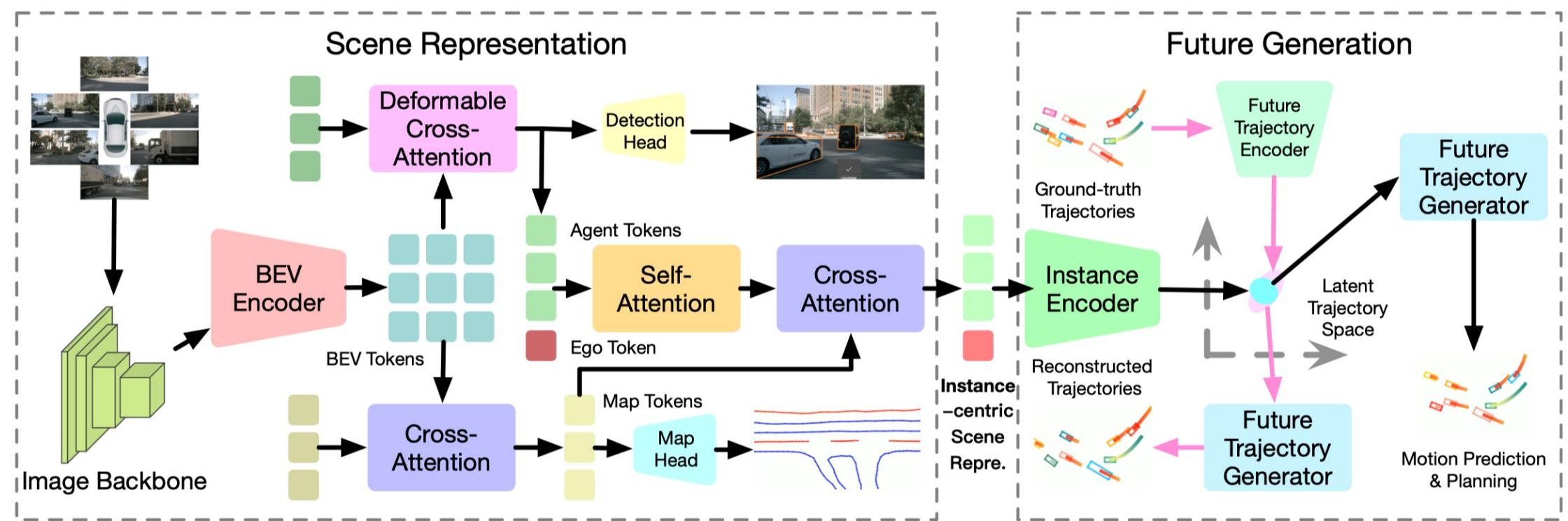

GenAD:生成式端到端自动驾驶

GenAD(Generative End-to-End Autonomous Driving, Zheng et al., 2024)提出了一种全新的思路:将轨迹预测和规划问题建模为生成任务。

图 24-7:GenAD 的框架(来源:Zheng et al., 2024)。图像通过 backbone 和 BEV 编码器生成 BEV tokens,结合地图和智能体 tokens 构建实例中心的场景表示,再映射到结构化的潜在轨迹空间(Latent Trajectory Space),通过未来轨迹生成器同时完成运动预测和自车规划。

与 UniAD 将规划视为"回归"问题(直接预测轨迹坐标)不同,GenAD 将轨迹映射到一个结构化的潜在空间中,通过生成模型采样多条可能的未来轨迹。这一设计的优势在于:

- 多模态输出:真实驾驶场景中往往存在多种合理的驾驶选择(超车、跟车、变道),生成式方法可以输出多条候选轨迹及其概率分布,而非强制回归到唯一"正确答案"。

- 更好的泛化:潜在空间中学到的轨迹分布可以推广到训练集中未见过的场景组合。

- 统一的预测与规划:GenAD 使用同一个未来轨迹生成器(Future Trajectory Generator)同时输出周围车辆的预测轨迹和自车的规划轨迹。这种"预测即规划"的设计避免了传统方案中预测模块和规划模块的割裂。

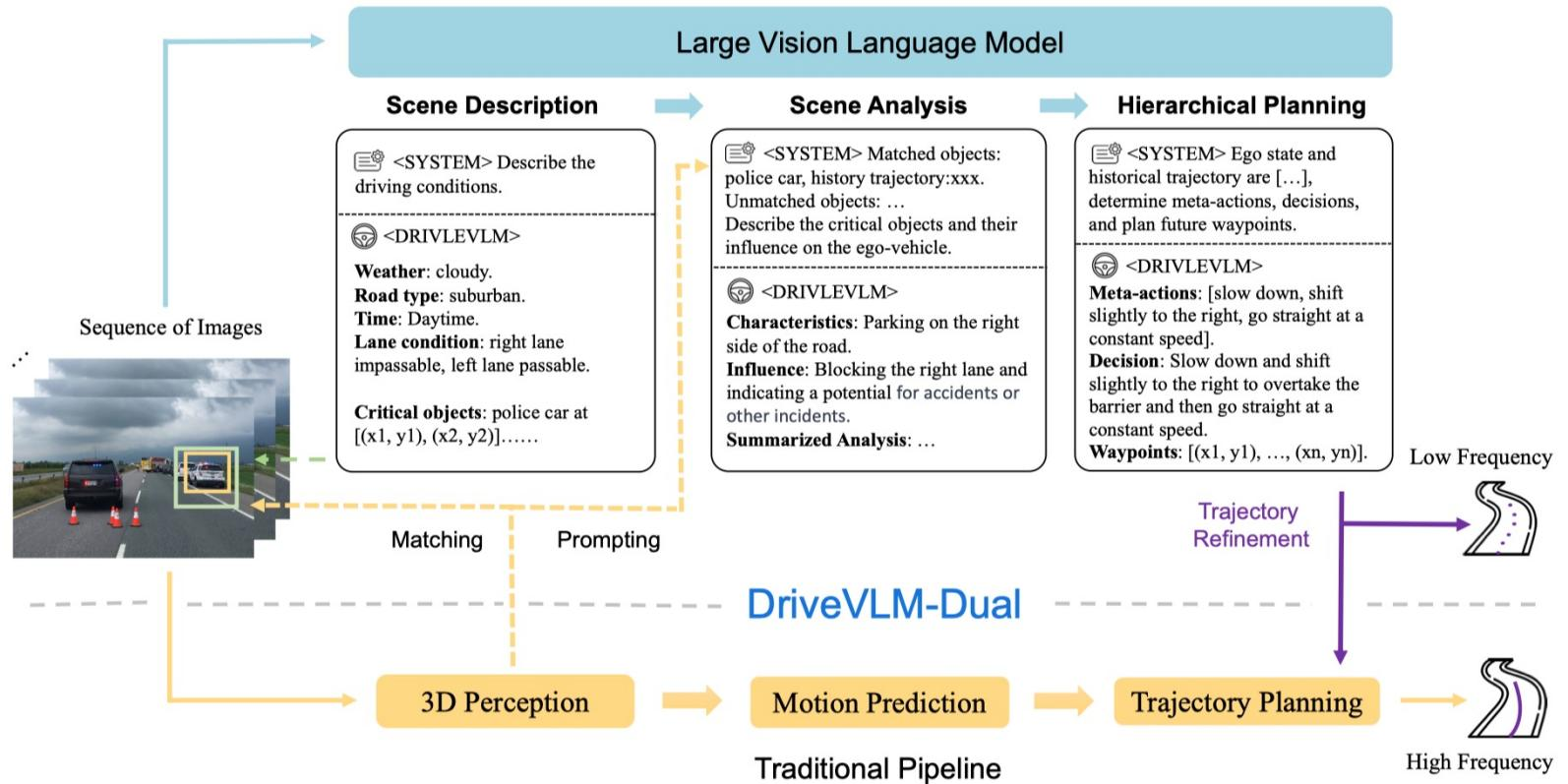

DriveVLM:视觉语言模型驱动的自动驾驶

DriveVLM(Tian et al., 2024)由理想汽车和清华大学联合提出,代表了另一条技术路线:将大规模视觉语言模型(VLM)引入自动驾驶的决策链路。

图 24-8:DriveVLM 的双系统架构(来源:Tian et al., 2024)。上方路径:VLM 以低频运行,通过 Chain-of-Thought 机制逐步输出场景描述、场景分析和分层规划。下方路径:传统 3D 感知 + 运动预测 + 轨迹规划管线以高频运行。DriveVLM-Dual 通过轨迹精炼机制融合两条路径的输出。

DriveVLM 的核心设计理念是模仿人类驾驶员的"快思考"与"慢思考"双系统:

- "慢系统"(VLM 路径):大规模视觉语言模型以较低频率运行,通过 Chain-of-Thought(思维链)机制,先描述当前场景(天气、道路状况、关键对象),再分析各对象对自车的影响,最后输出分层的驾驶决策(如"减速→左变道→低速直行")。这条路径善于处理复杂的长尾场景和需要常识推理的情况。

- "快系统"(传统感知管线):标准的 3D 感知 + 运动预测 + 轨迹规划流水线以高频率运行,确保实时响应。

两个系统通过轨迹精炼(Trajectory Refinement)机制融合——VLM 输出的高层决策指导传统管线的轨迹生成,传统管线的高频输出弥补 VLM 推理延迟的不足。

DriveVLM 的创新意义在于将大模型的语义理解能力和常识推理能力引入自动驾驶。例如,当前方出现施工区域时,VLM 可以通过文字推理"前方右车道有施工围栏,应减速并向左变道",输出人类可读的决策链,而这种复杂场景对传统感知-规划管线来说可能是从未见过的长尾案例。不过,VLM 的推理延迟(通常在数百毫秒量级)使其无法单独承担实时控制任务,"快慢双系统"的混合架构因此成为必然选择。

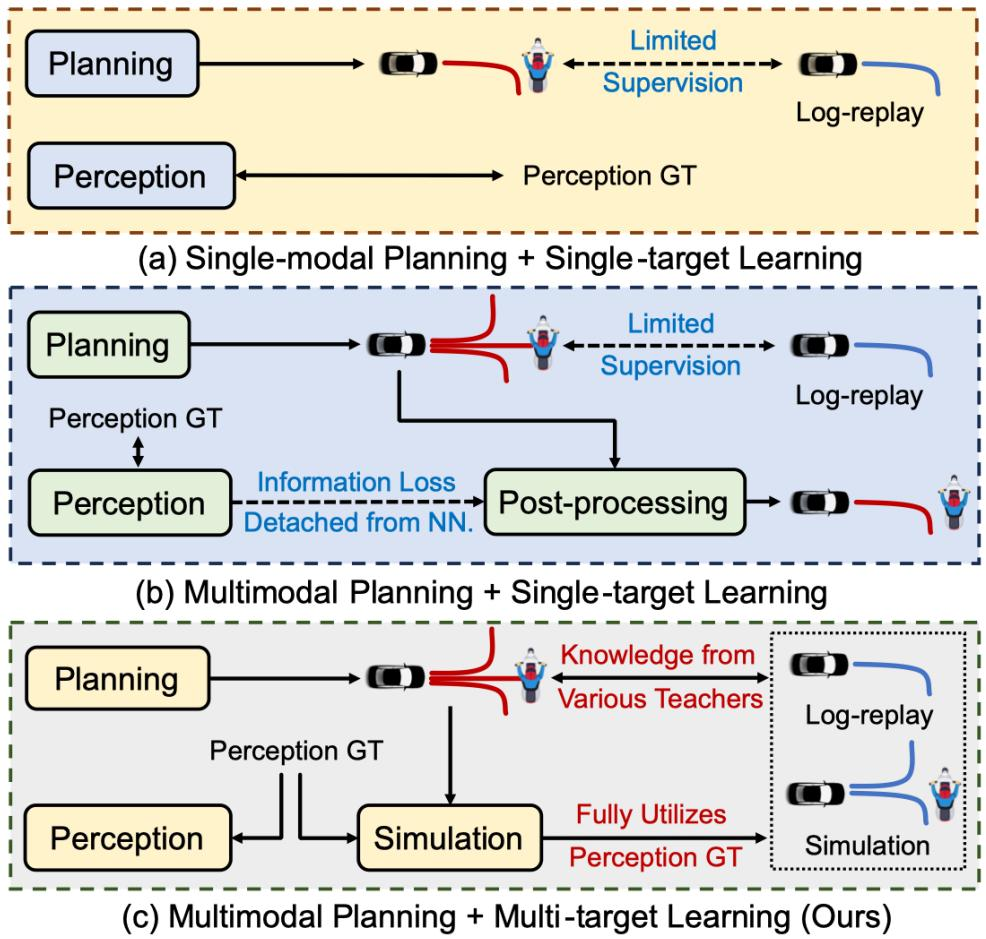

Hydra-MDP:多目标学习的规划范式

Hydra-MDP(Li et al., 2024)由 NVIDIA 提出,关注的核心问题是:端到端规划应该如何设计训练目标?

图 24-9:端到端规划范式的演进(来源:Li et al., 2024)。(a) 单模态规划 + 单目标学习;(b) 多模态规划 + 单目标学习,引入后处理来弥补感知信息损失;(c) Hydra-MDP 的多模态规划 + 多目标学习,融合多个教师模型的知识和仿真验证。

Hydra-MDP 提出的关键改进包括:

- 多模态规划:输出多条候选轨迹而非单一轨迹,每条轨迹对应不同的驾驶意图(如"保持车道"、"左变道"等)。

- 多目标学习:同时从多个"教师"(包括专家规划器、仿真环境反馈、感知真值等)获取监督信号,而非仅模仿人类驾驶轨迹。通过仿真器进行闭环验证,充分利用感知真值信息。

Hydra-MDP 的命名源自希腊神话中的"九头蛇"——多个"头"(即多条候选轨迹和多个教师信号)共同驱动规划决策。这一设计思路解决了端到端规划中长期存在的 mode collapse(模式坍缩)问题:当训练目标仅有单一人类轨迹时,模型倾向于输出所有训练样本的"平均轨迹",而非针对当前场景的最优轨迹。

24.1.5 技术路线之争与产业实践

两条端到端演进路径

从传统级联到端到端,业界存在两条不同的演进路径:

路径一:从感知端出发。先解决感知与规划之间的信息瓶颈问题——传统架构中感知模块输出结构化结果(如 bounding box)时丢失了大量有用信息。这条路线的思路是让感知模块直接向规划模块传递丰富的特征表示(如 BEV 特征、占用网格),消除中间表示的信息损失。UniAD 是这一路线的代表。

路径二:从规划端出发。先解决规划效果的问题,因为规划是对最终驾驶体验影响最直接的模块。具体方案包括:(1)先用成熟的预测模型输出粗略规划结果,再用规则修正;(2)使用多模型评分,输出大量候选轨迹,通过打分机制选优;(3)结合上述两者,用统一的融合模型完成预测和评分。Hydra-MDP 和 GenAD 更接近这一路线。

产业界的技术选择

| 企业/平台 | 技术路线 | 核心特点 |

|---|---|---|

| 特斯拉 FSD V12 | 端到端大模型 + 规则兜底 | 纯视觉输入,代码量从 30 万行缩减到约 2000 行 |

| 百度 Apollo ADFM | 感知大模型 + 规划大模型(级联) | 多传感器融合,L4 级无人运营 |

| 小鹏 XNGP | 神经网络 XNet + 规控 XPlanner + VLM XBrain | 三模块协同,XBrain 负责大场景认知 |

| 理想 | 端到端 + VLM + 生成式验证 | 强调"快慢双系统"理念 |

| 华为 ADS 3.0 | 端到端架构 | 追求类人驾驶体验 |

特斯拉的案例最具代表性。FSD V12 被认为是第一个大规模上车的端到端系统——Elon Musk 声称它"几乎完全由神经网络驱动"。但即便如此,仍保留了规则兜底策略来处理极端安全场景。这反映了业界的普遍共识:纯端到端尚未完全取代规则兜底,传统 AD 的技术积累并未被抛弃,而是从前台迁移到了幕后。

"端到端"的边界在哪里? 学术界对此尚无统一结论。无论是感知后处理、规划候选轨迹评分,还是安全兜底策略,只要引入了规则代码(if-else 逻辑),系统就不是完全可微分的,从而损失了端到端通过训练获得全局优化的理论优势。但从工程实践角度看,在安全攸关的自动驾驶领域,完全去除规则兜底在当前阶段既不现实也不负责任。端到端与规则的混合架构将在相当长的时间内作为过渡形态存在。

核心挑战

端到端自动驾驶面临的关键挑战包括:

算力瓶颈。端到端大模型的训练需要海量计算资源。Musk 曾表示 FSD 的最大限制因素是算力——特斯拉在 2024 年已部署约 35,000 块 H100 GPU,并计划年底扩展到 85,000 块。

数据飞轮。与传统方案不同,端到端模型的性能高度依赖训练数据的规模和质量。特斯拉依靠全球数百万辆量产车的影子模式(Shadow Mode)持续采集驾驶数据,形成了独特的数据飞轮优势——更多数据训练更好的模型,更好的模型吸引更多用户,更多用户产生更多数据。

可解释性困境。端到端模型本质上是一个"黑盒"——当系统做出一个不合理的驾驶决策时,工程师很难定位问题出在感知层面还是规划层面。DriveVLM 通过 Chain-of-Thought 机制部分缓解了这一问题:VLM 生成的中间文本(场景描述、分析、决策理由)为人类提供了可审查的推理过程。

安全验证。自动驾驶的安全标准极高——通常需要证明系统的事故率显著低于人类驾驶员(例如百度声称安全性"高于人类驾驶员 10 倍以上")。然而,端到端模型的行为由训练数据和网络参数隐式决定,传统的形式化验证方法(如 SOTIF、RSS)难以直接应用,新的安全评估框架仍在探索中。

组织变革。端到端技术不仅改变了软件架构,也深刻影响了团队组织。传统 L4 自动驾驶公司通常按功能模块设置团队(感知组、预测组、规划控制组),端到端架构打破了模块边界,要求团队整合协作。蔚来曾将原感知部门与规控部门的模型团队合并为统一的"大模型部",取消了按功能划分的组织结构。

本节小结

端到端自动驾驶代表了从"规则驱动"到"数据驱动"的范式转变。传统级联架构虽然可解释性强、安全性有保障,但受限于级联误差累积和信息损失;端到端方案通过全局可微的统一网络消除了这些问题,但在安全性、可解释性和算力需求上面临新的挑战。当前业界的主流实践是在端到端神经网络的基础上保留规则兜底机制,同时引入 VLM 提升复杂场景的推理能力。UniAD、GenAD、DriveVLM 和 Hydra-MDP 分别从不同角度推进了端到端技术的前沿——UniAD 实现了以规划为导向的统一架构,GenAD 引入了生成式轨迹建模,DriveVLM 融合了视觉语言模型的推理能力,Hydra-MDP 则优化了多目标学习框架。随着算力的持续增长和数据飞轮的加速运转,端到端自动驾驶有望成为智能驾驶的主流技术范式。