2.1 序列建模回顾

大语言模型的本质,是对自然语言序列的概率建模。在 Transformer 横空出世之前,研究者已经花了数十年时间探索如何让机器理解和生成序列数据。这段历史不仅仅是"过时的技术"——从 N-gram 到 RNN 再到 LSTM/GRU,每一代模型所面对的核心问题(如何建模长距离依赖、如何高效训练、如何评估模型好坏)至今仍然深刻影响着大模型的设计哲学。

本节将沿着这条技术脉络,从语言模型的概率基础出发,经过统计方法(N-gram)与神经方法(RNN/LSTM/GRU)的关键节点,最终抵达训练循环网络的核心算法——通过时间的反向传播(BPTT)。理解这些基础,是后续真正读懂 Transformer 注意力机制和现代大模型架构的必要前提。

2.1.1 语言模型的概率基础

**语言模型(Language Model)**的目标只有一个:给定一段文本序列

这个分解是精确的,没有任何近似。它告诉我们:一个语言模型的核心任务,就是学会估计下一个词的条件概率分布

问题在于,随着序列长度

2.1.2 N-gram:统计语言模型的基石

最经典的近似策略来自 N-gram 模型,它基于一个简洁的假设——马尔可夫假设(Markov Assumption):一个词出现的概率仅依赖于它前面的

以 trigram(

于是整个句子的概率变为:

每个条件概率通过**最大似然估计(MLE)**从大规模语料库中"数数"得到:

这个方法简单、高效、可解释,在神经网络兴起之前长期统治着语音识别和机器翻译领域。Google 在 2007 年曾基于 2 万亿 token 的语料训练了一个 5-gram 模型,其规模在当时已经惊人。

然而 N-gram 有三个根本性缺陷:

数据稀疏性。 随着

无法捕捉长距离依赖。 马尔可夫假设的本质决定了 N-gram 只能看到一个很小的上下文窗口。句子中相隔较远的语法和语义关系——比如主语与远处谓语的一致性——完全超出了它的建模能力。

缺乏泛化能力。 对于 N-gram 模型,"cat"和"kitty"是两个完全无关的符号。它无法将在"the cat sat on"上学到的统计规律迁移到"the kitty sat on"。

这三个缺陷直接催生了神经语言模型的发展:词嵌入(Word Embedding)解决了泛化问题,而循环神经网络则试图突破固定窗口的限制。

2.1.3 困惑度:语言模型的评估标尺

在引入神经方法之前,我们需要一个标准化的指标来衡量语言模型的好坏。**困惑度(Perplexity, PPL)**正是这把标尺。

对于一个长度为

等价地,它可以理解为每个 token 逆概率的几何平均数:

直觉理解: 困惑度衡量的是模型在预测下一个词时平均面临的"有效选项数量"。PPL

困惑度与**交叉熵(Cross-Entropy)**直接相关:

使用困惑度进行模型比较时,有几个必须遵守的前提条件:必须在同一个测试集上评估(不同文本难度不同);必须使用完全相同的词汇表和分词方法(不同的 tokenizer 产生不同的 token 序列,困惑度不可直接比较);还需注意词汇表大小对困惑度基线水平的影响(词汇表越大,基线困惑度越高)。

2.1.4 循环神经网络(RNN):让网络拥有记忆

N-gram 模型的核心局限在于固定窗口。一个自然的想法是:能否让模型拥有一种"记忆",在处理每个新词时不仅看到当前输入,还能利用之前所有历史信息?**循环神经网络(Recurrent Neural Network, RNN)**正是这一想法的实现。

RNN 的核心设计是参数共享的循环计算。在每个时间步

其中

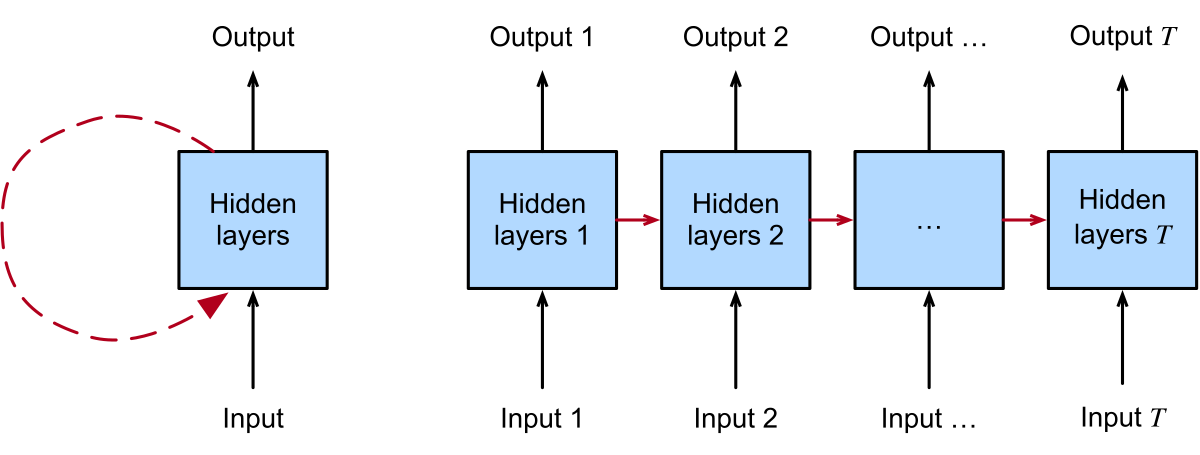

如果把循环展开来看,RNN 就是一个所有层共享参数的超深前馈网络——每处理一个时间步,就相当于多了一"层"。下图展示了这种展开视图:左侧是带环路的紧凑表示,右侧是沿时间轴展开后的等价结构。

RNN 的优势很明显:通过隐状态传递机制,它理论上能利用任意长的历史信息;参数共享使得模型规模不随序列长度增长;并且能自然地处理变长输入。

然而实践中,RNN 的记忆能力远没有理论上那么美好。考虑这样一个句子:"小强是一个爱学习、有礼貌、每次考试成绩都很好、同时又热爱各种体育活动的好学生。老师们都很喜欢他。"模型需要从很远的"小强"推断出最后应该是"他"而不是"她"。但隐状态在经过大量时间步的线性变换和激活函数压缩后,早期信息往往已经严重衰减。

从梯度流的角度看,这个问题同样严峻。我们将在 §2.1.7 中详细分析:反向传播时梯度需要穿越大量时间步的矩阵连乘,指数级的缩放会导致梯度消失或梯度爆炸——这是简单 RNN 在实践中最致命的问题。

2.1.5 LSTM:用门控机制拯救长期记忆

1997 年,Hochreiter 和 Schmidhuber 提出了长短期记忆网络(Long Short-Term Memory, LSTM),通过引入精心设计的门控机制和独立的记忆通道来解决梯度消失问题。LSTM 是 2010 年代深度学习在序列建模领域取得突破的核心架构,从手写识别、机器翻译到语音合成,几乎所有序列任务的最佳方案都曾基于 LSTM。

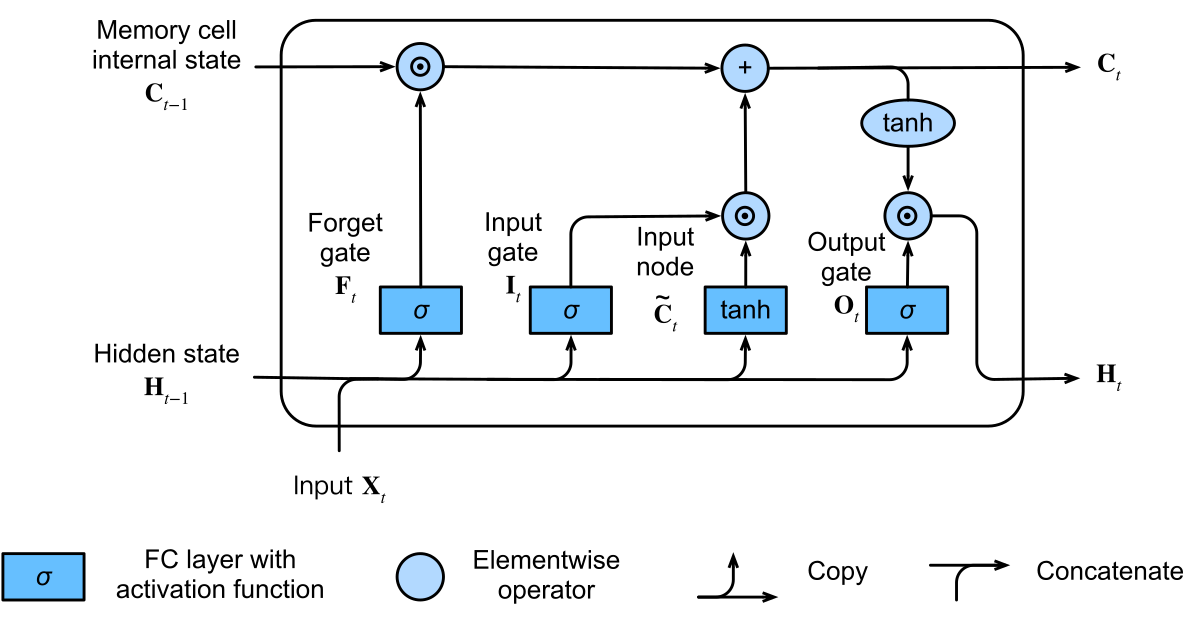

LSTM 的关键创新是在隐状态之外引入了一个记忆细胞状态(cell state)

"长短期记忆"这个名字本身就揭示了设计思想:普通 RNN 的权重是缓慢变化的"长期记忆"(编码通用知识),激活值是快速流逝的"短期记忆"。LSTM 通过记忆细胞引入了一种介于两者之间的中期记忆——它可以稳定保持很多个时间步,也可以在需要时被选择性地更新或遗忘。

三个门的计算。 输入门

候选记忆与记忆更新。 同时计算一个候选记忆(输入节点)

记忆细胞的更新是 LSTM 最核心的方程——遗忘门控制保留多少旧记忆,输入门控制写入多少新信息,两者通过逐元素乘法(Hadamard 积

隐状态输出。 最终的隐状态由输出门控制记忆细胞中有多少信息可以对外暴露:

LSTM 能缓解梯度消失的关键,在于记忆细胞状态

2.1.6 GRU:更轻量的门控方案

LSTM 的有效性已被广泛验证,但它的四组参数(三个门加一个输入节点)带来了不小的计算开销。2014 年,Cho 等人提出了门控循环单元(Gated Recurrent Unit, GRU),将 LSTM 的三个门简化为两个,去掉了独立的记忆细胞,仅靠隐状态就实现了类似的长期记忆能力。

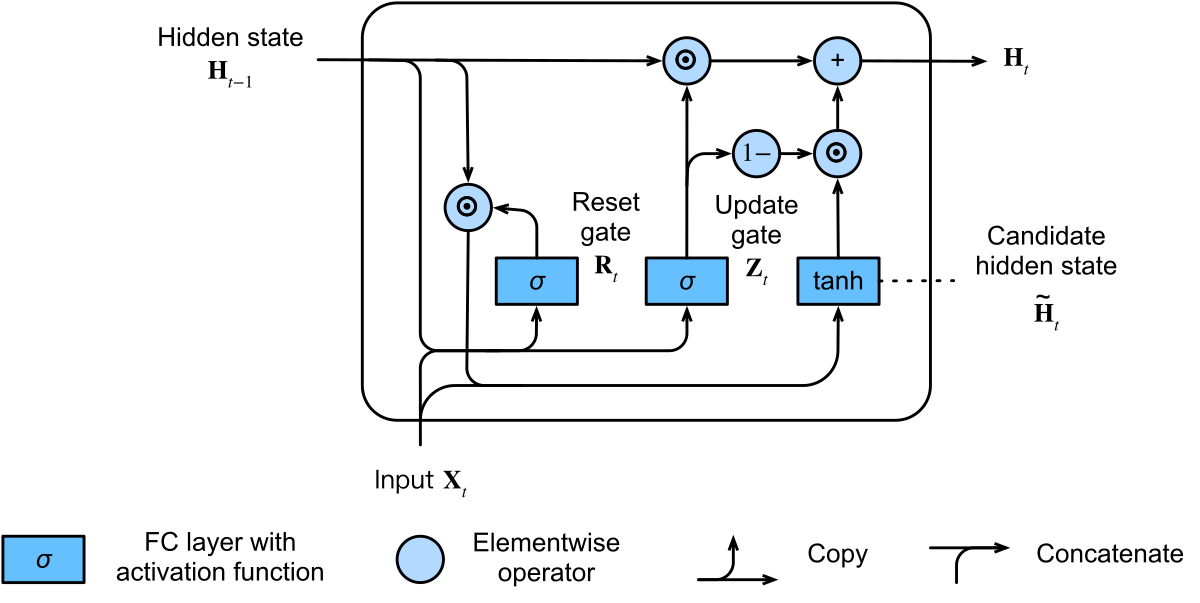

GRU 只使用两个门:重置门(reset gate)

重置门控制从旧隐状态中读取多少信息来生成候选隐状态

当

更新门的角色类似于 LSTM 中遗忘门和输入门的合体——它用一个门同时决定保留多少旧状态、写入多少新状态:

这个凸组合非常优雅:

GRU 与 LSTM 的对比可以简洁地总结:GRU 参数更少(两组门 vs. 三组门加记忆细胞),训练速度更快,在许多任务上性能与 LSTM 相当甚至接近。当计算预算有限时,GRU 是一个值得优先尝试的选择。不过 LSTM 在需要更精细的记忆控制的场景下(如非常长的序列或复杂的依赖结构)通常仍有优势。

2.1.7 BPTT:通过时间反向传播与截断策略

训练 RNN(包括 LSTM 和 GRU)的标准方法是通过时间的反向传播(Backpropagation Through Time, BPTT)(Werbos, 1990)。其核心思路是:将 RNN 沿时间轴展开为一个深度等于序列长度的前馈网络,然后应用标准的反向传播算法。

考虑一个简化的 RNN 模型。在每个时间步

目标函数是所有时间步上损失的平均:

计算

递归展开这个表达式可得 [选读]:

这里的关键是连乘项

梯度爆炸可以通过梯度裁剪(gradient clipping)来缓解——当梯度范数超过阈值时,按比例缩小。但梯度消失是更深层的结构性问题,这正是 LSTM 和 GRU 的门控机制所解决的。

在实践中,完整的 BPTT 代价太高(内存和计算都随序列长度线性增长),因此普遍采用截断 BPTT(Truncated BPTT):将序列切分为长度为

截断 BPTT 还带来一个附带好处:它对模型产生了一种隐式正则化效果,偏向于学习短程交互模式而非过于复杂的长程依赖——这在很多实际任务中反而是有利的。

2.1.8 小结

本节从语言建模的概率基础出发,回顾了序列建模的核心技术脉络:

- 链式法则分解是所有语言模型的理论基础——将联合概率分解为逐步预测下一个词的条件概率。

- N-gram 通过马尔可夫假设将问题简化为固定窗口内的统计计数,简单高效但受限于稀疏性和短程依赖。

- **困惑度(PPL)**作为交叉熵的指数形式,提供了比较语言模型性能的标准化指标。

- RNN 通过隐状态引入了理论上无限长的记忆,但梯度消失使其在实践中难以捕捉长距离依赖。

- LSTM 通过记忆细胞和三门机制(输入门、遗忘门、输出门)建立了梯度的"高速公路",有效缓解了梯度消失问题。

- GRU 用两个门(重置门、更新门)实现了与 LSTM 相当的效果,同时减少了参数量和计算开销。

- BPTT 是训练循环网络的标准算法,截断策略在计算效率与梯度精度之间取得了实用的平衡。

这些技术构成了序列建模的"经典范式"。然而,无论是 LSTM 还是 GRU,其本质上的逐步递推结构使得计算无法并行化,训练效率随序列长度线性下降。这个根本性的瓶颈,正是下一节将要介绍的 Transformer 架构所要解决的核心问题。