17.0 时代背景与范式转换

大语言模型的发展史,从宏观上看就是一部不断寻找"下一个扩展维度"的历史。从 GPT-3 到 ChatGPT,业界沿着 Scaling Law(缩放定律)的指引,在预训练阶段堆叠参数、灌注数据、燃烧算力,将模型能力推向了一个又一个高峰。然而,当预训练的边际收益开始放缓,一种全新的范式悄然登场——推理模型(Reasoning Model)。它不再追求"在训练时投入更多",而是让模型"在推理时思考更久"。这一范式转换,堪称大模型时代最深刻的一次革命。

本节将从预训练 Scaling Law 的辉煌与瓶颈讲起,沿着思维链、过程奖励模型、强化学习三条技术脉络,完整还原推理模型的诞生逻辑,为后续章节的深入学习建立全局视角。

17.0.1 预训练 Scaling Law:辉煌与瓶颈

Scaling Law 的核心主张。 2020 年 OpenAI 的 Kaplan 等人在论文 Scaling Laws for Neural Language Models 中首次系统性地揭示:语言模型的验证损失(Test Loss)与三个宏观变量之间存在严格的幂律关系:

其中

这个公式的核心含义是:只要持续增加参数、数据和算力,模型性能就会可预测地变好。 这为动辄数千万美元的大模型训练提供了工程上的信心。

图 17-1:Scaling Law 的核心图景。横轴为计算量/数据量/参数量(对数坐标),纵轴为损失值。三者均呈现出清晰的幂律下降趋势。

Chinchilla 定律的修正。 2022 年 DeepMind 提出的 Chinchilla 定律进一步指出:Kaplan 等人高估了参数量的权重,低估了数据量的重要性。最优策略应当是参数量与数据量同比例扩展——当算力预算增加 10 倍时,两者各增加约

三面墙:预训练 Scaling 的瓶颈。 然而 Scaling Law 并非永动机。随着它成为行业共识,纯粹靠"在预训练阶段堆资源"的路线开始撞上三面墙:

| 瓶颈 | 核心矛盾 | 典型应对 |

|---|---|---|

| 数据墙(Data Wall) | 高质量人类文本数据即将耗尽 | 合成数据、数据质量过滤 |

| 算力墙(Compute Wall) | Dense 模型无限做大导致训练与部署成本无法承受 | MoE 架构、模型压缩 |

| 能力墙(Capability Wall) | 预训练 Loss 的下降未必转化为下游任务的等比例提升 | 后训练、强化学习 |

表 17-1:预训练 Scaling 面临的三大瓶颈。

以高中数学竞赛数据集 MATH 为例,可以直观感受"参数堆叠"与"范式创新"之间的巨大差距:

- GPT-3(175B 参数,few-shot):5.6%(2021 年)

- Qwen2.5-Math-7B(思维链微调):83.6%(2024 年)

- Qwen3-1.7B(长链推理):93.4%(2025 年)

一个 1.7B 参数的小模型,通过推理范式的创新,在数学任务上远超 175B 参数的 GPT-3——这说明模型"怎么想"可能比"多大"更重要。

17.0.2 思维链:从语言生成到逐步推理

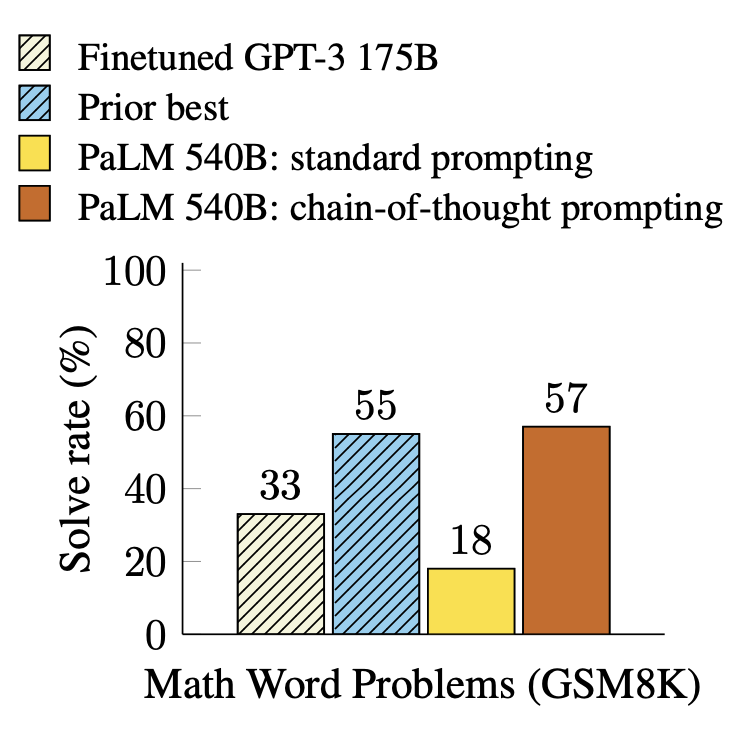

从"直接回答"到"分步思考"。 2022 年 Google 的论文 Chain-of-Thought Prompting Elicits Reasoning in Large Language Models 提出了一个看似简单却影响深远的发现:只要在提示词(Prompt)中展示中间推理步骤,而非仅给出最终答案,大模型就能自主地生成类似的"思考过程",从而大幅提升在数学、逻辑等推理任务上的表现。

图 17-2:思维链(Chain-of-Thought)的效果对比。左侧为标准提示,右侧为思维链提示,后者通过展示推理步骤显著提升了正确率。

更令人惊喜的是,Zero-shot CoT(零样本思维链)的发现:仅在提示末尾加一句 "Let's think step by step",无需任何推理示例,就能激发模型的逐步推理能力。这揭示了一个关键洞察:

大模型的推理能力并非不存在,而是需要被"激活"。

从技术本质上看,思维链的工作原理可以这样理解:生成单个 Token 的过程(即一次模型前向传播)所包含的计算量是固定的。对于需要多步逻辑推演的复杂问题,模型无法在单次计算中完成求解。因此,必须通过生成一系列包含中间步骤的 Token 来逐步展开"思考"过程——每个 Token 的生成都相当于一次额外的计算。这就是 Test-Time Compute Scaling(测试时计算扩展)的朴素起点。

17.0.3 过程奖励与搜索:让推理更可靠

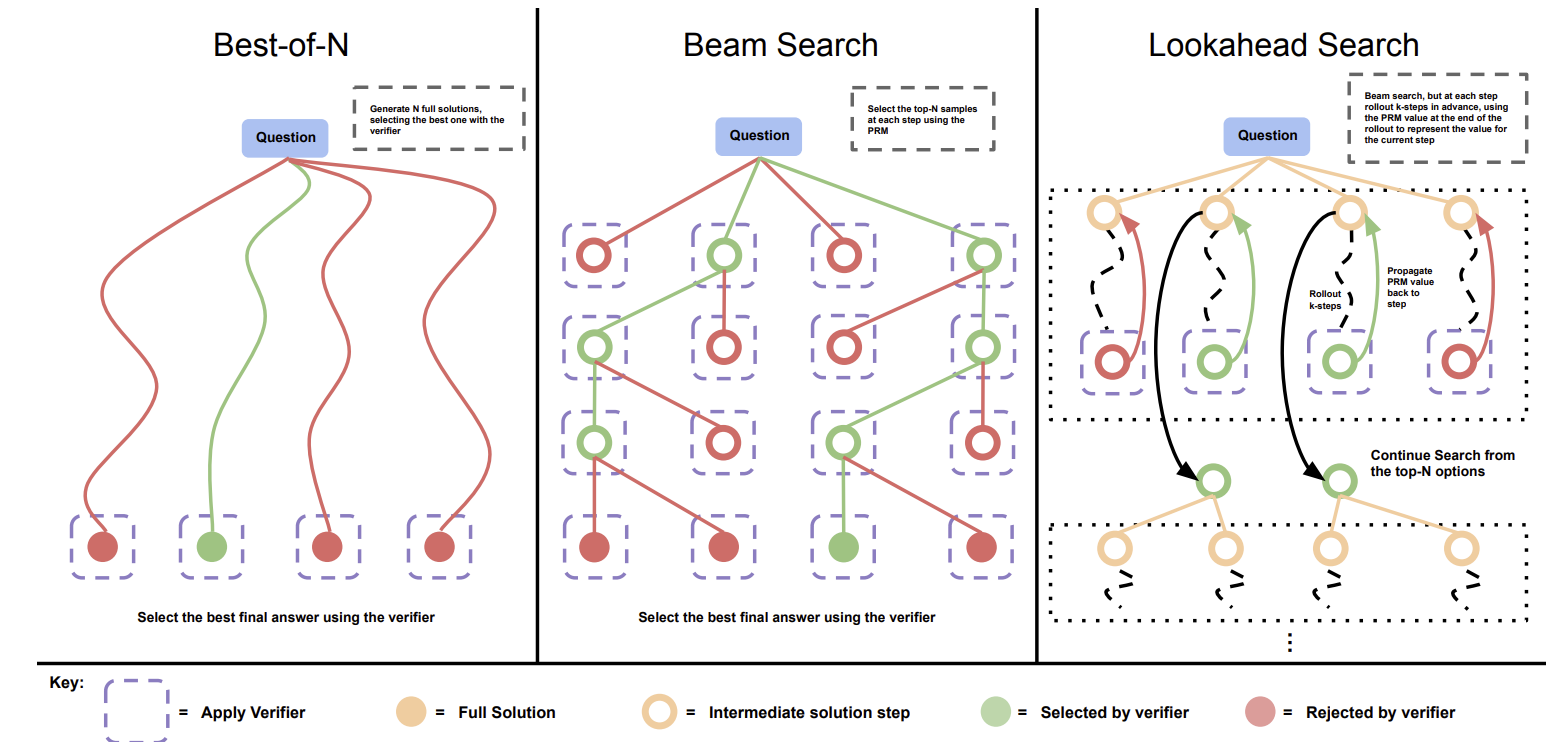

思维链提示虽然有效,但它依赖于手工设计的示例,且无法保证每一步推理都正确。为了让模型的推理过程更加可靠,研究者引入了两个关键工具:过程奖励模型(Process Reward Model, PRM)和搜索算法。

PRM 的核心思想。 2023 年 OpenAI 在论文 Let's Verify Step by Step 中提出:与其只看最终答案对不对(结果奖励),不如对推理链中的每一步进行打分。他们人工标注了 MATH 数据集中 1.2 万道题、7.5 万个解答、总计 80 万个步骤的正确性,训练出的 PRM 在指导 GPT-4 解题时效果显著优于仅看结果的 ORM(Outcome Reward Model)。

搜索策略。 有了逐步打分的能力,就可以用搜索算法在推理空间中寻找最优路径。三种主流方案如下:

图 17-3:基于过程奖励模型的三种搜索策略对比。

Best-of-N 采样:针对同一问题独立生成

个完整解答,由 PRM 对每个解答的各步骤评分,选择总分最高者作为最终输出。简单直接,但计算开销随 线性增长。 Beam Search(集束搜索):在推理的每一步维持

个最优候选路径。从问题出发生成 个第一步,PRM 评分后保留前 个;以此类推,直到生成完整解答。相比 Best-of-N 能更早剪枝。 Lookahead Search(前瞻搜索):在选择当前步骤时,先"预演"未来

步,用 PRM 评估预演终点的质量来反向评估当前选择的优劣。

这些方法的本质都是在推理阶段投入更多计算资源来换取更高质量的输出——但它们有两个根本局限:PRM 的标注成本极高,且搜索空间随问题复杂度呈指数爆炸。

17.0.4 强化学习驱动:推理模型的诞生

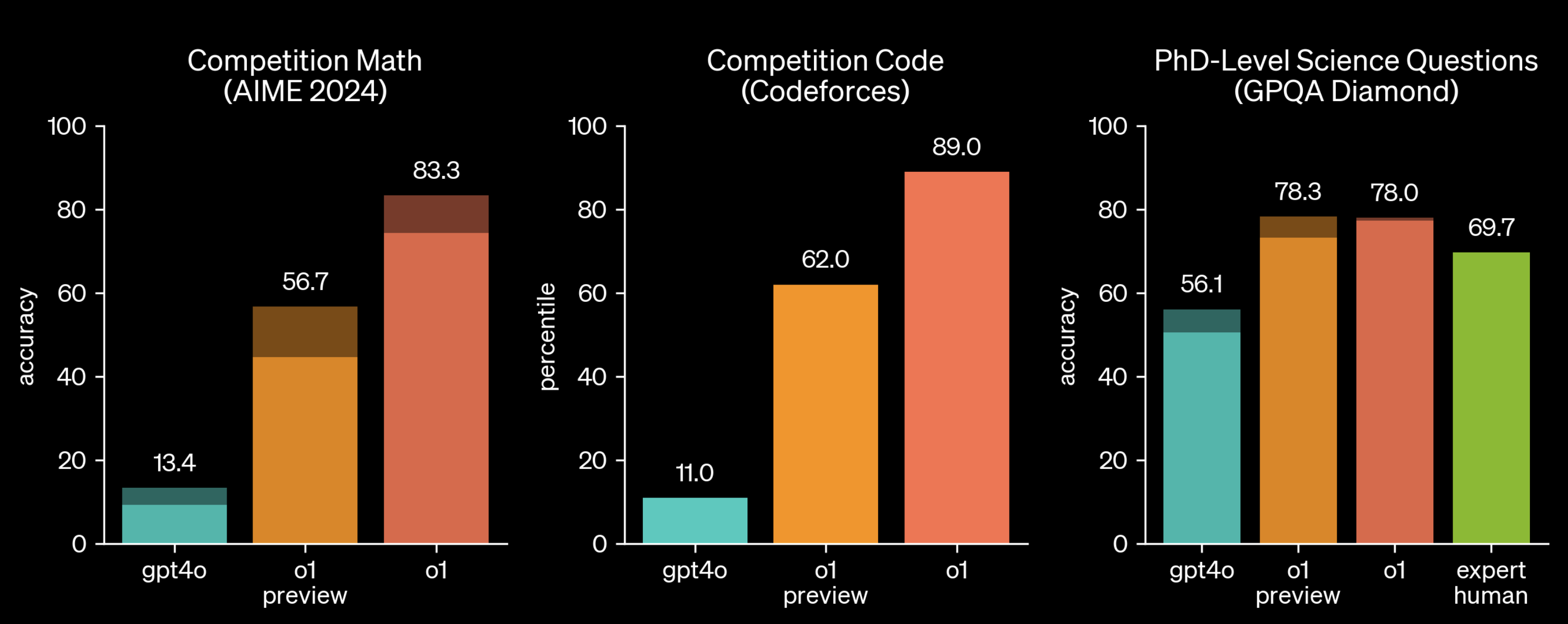

真正的范式突破来自强化学习(Reinforcement Learning, RL)。2024 年 9 月,OpenAI 发布了内部代号为"草莓"(Strawberry)的推理模型 o1,在数学、编码、科学推理等任务上实现了性能的跃迁式进步。

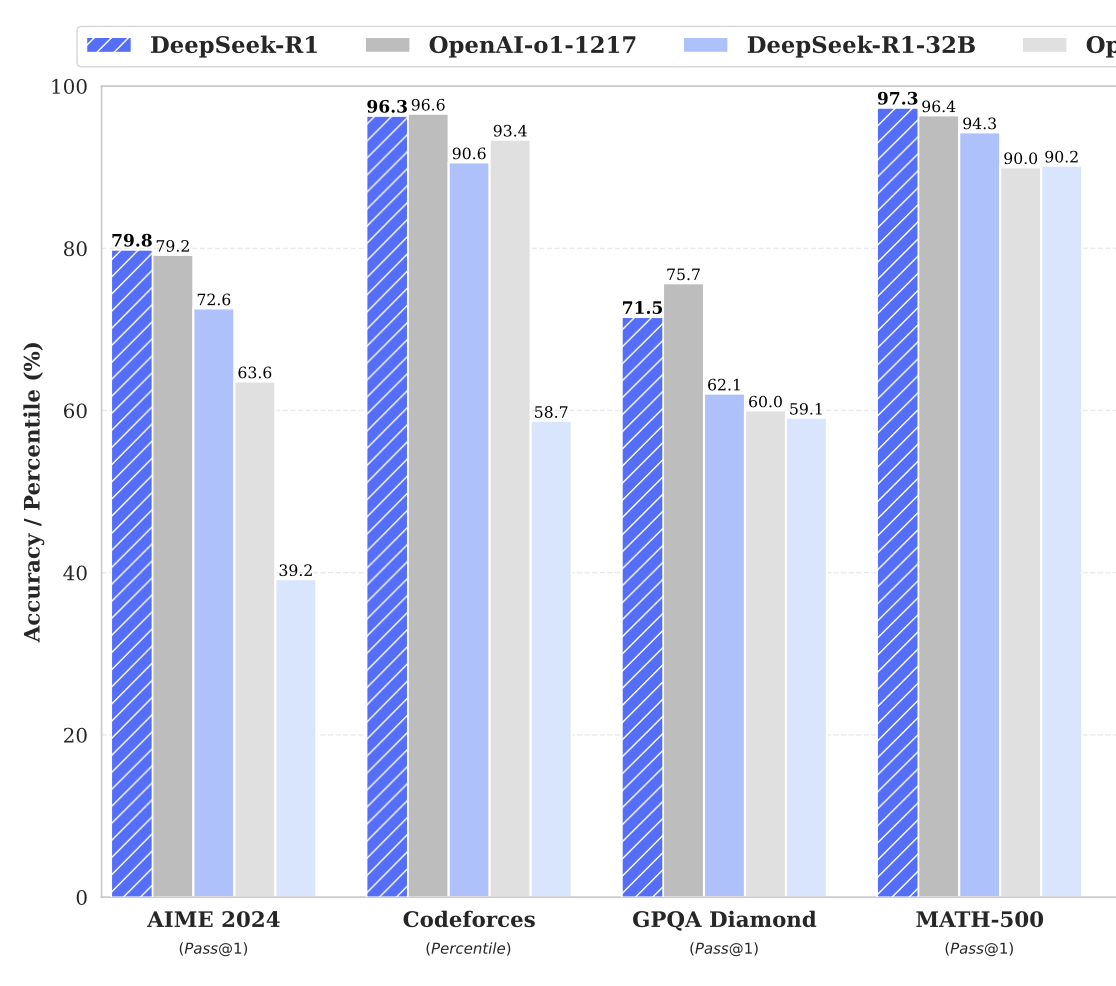

图 17-4:OpenAI o1 的性能表现。在数学竞赛(AIME)、编程(Codeforces)、科学推理(GPQA)等基准上均大幅领先此前的模型。

o1 展示了令人震撼的超长思维链——其内部推理过程极度复杂而细致,如同一位真正领域专家的内心活动。但 OpenAI 将几乎所有训练细节保密,只透露了一个关键词:强化学习。

DeepSeek-R1:开源揭秘。 2025 年 1 月 21 日,DeepSeek 团队发布了 DeepSeek-R1,它是 o1 之后第一个大型开源推理模型,不仅在各项指标上匹敌当时最强的 o1,API 价格仅为 o1 的百分之一,而且完全公开了训练技术细节,引发了整个行业的震动。

图 17-5:DeepSeek-R1 在多项基准上的表现与 OpenAI o1 的对比。

DeepSeek-R1 的核心技术方案可以用"至简即至强"来概括。其最关键的贡献是 DeepSeek-R1-Zero——一个完全通过强化学习、不经过任何监督微调就获得推理能力的模型。具体做法是:

- 直接在基座模型上做 RL:跳过传统的 SFT(监督微调)阶段,直接对 DeepSeek-V3-Base 进行强化学习。

- 放弃奖励模型:不训练独立的 Reward Model,而是采用基于规则的可验证奖励(Rule-based Verifiable Reward)——对于数学和编程任务,直接比对最终答案的正确性作为奖励信号。

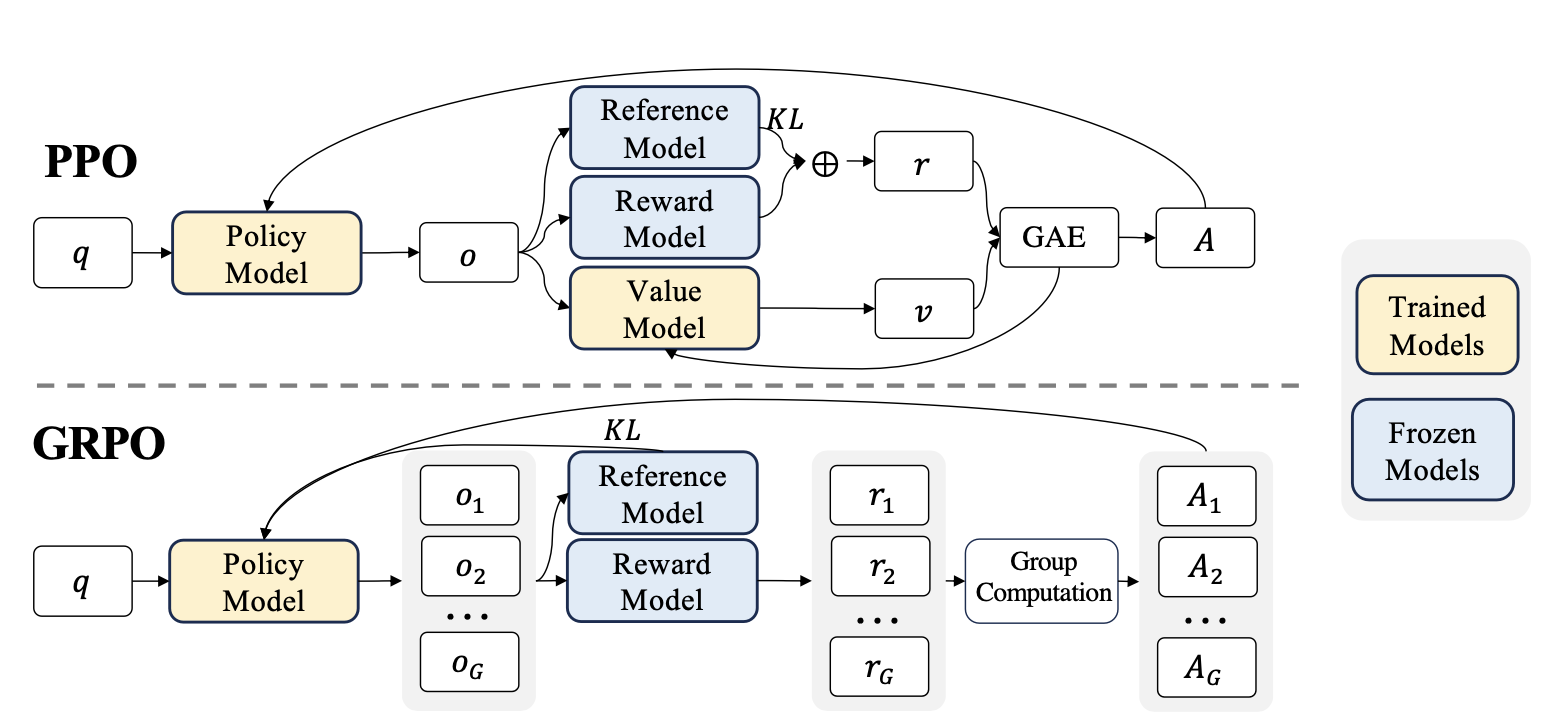

- 使用 GRPO 算法:采用 Group Relative Policy Optimization(群组相对策略优化),无需训练价值函数模型,仅通过比较同一问题的一组候选答案的相对优劣来估计优势函数。

图 17-6:经典 PPO 算法(上)与 GRPO 算法(下)的对比。GRPO 去除了独立的价值模型,通过组内相对比较来估计优势。

这套方案之所以能成功,关键在于可验证奖励绕过了奖励模型的所有陷阱:

- 直接答案比对取代 Reward Model → 奖励信号客观可靠

- 数学问题奖励稀疏 → 不需要 Value Model

- 答案比对稳定可靠 → 避免了 Reward Hacking → 不再需要 Reference Model

这套方案后来被称为 RLVR(RL with Verifiable Reward,基于可验证奖励的强化学习),成为推理模型训练的核心范式。

17.0.5 深度思考的涌现

DeepSeek-R1-Zero 最令人兴奋的发现不是最终性能数字,而是训练过程中观察到的涌现现象。

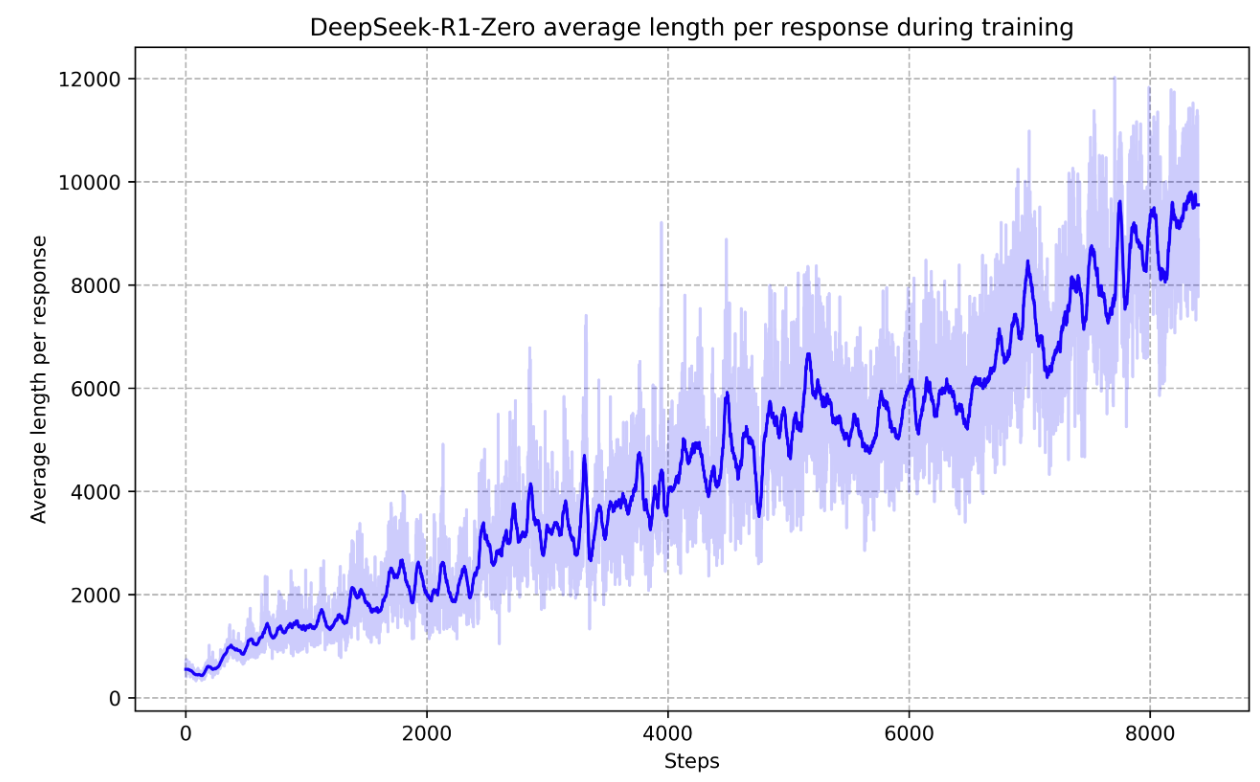

图 17-7:DeepSeek-R1-Zero 的训练曲线。随着 RL 训练的进行,模型的推理 Token 数自发增长,同时在 AIME 基准上的准确率持续上升。

在训练过程中,研究者观察到了以下行为的自发出现:

- 自我验证(Self-verification):模型学会在得出答案后回头检查自己的推理步骤。

- 自我纠错(Self-correction):模型发现错误后主动修正并重新推导。

- 反思(Reflection):模型在推理过程中产生"等等,让我重新想想"这样的元认知行为。

- 思考时间自适应:面对简单问题快速作答,面对复杂问题自动延长思考链。

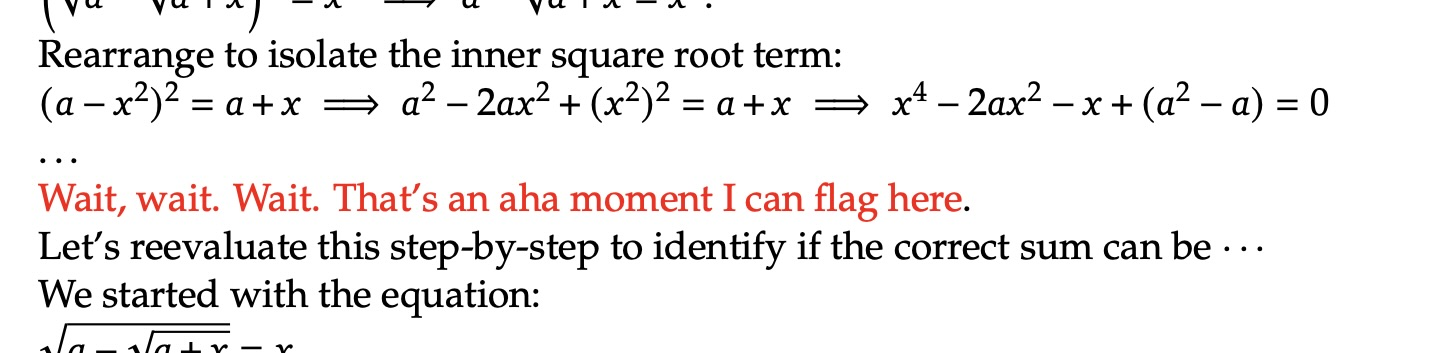

图 17-8:"Aha Moment"——模型在训练过程中自发学会了反思和自我纠错,这些行为并非人工设计,而是为了最大化奖励而涌现的内部策略。

这些能力并非通过人工设计或标注获得,而是模型为了最大化最终奖励而自发涌现的策略——这与 AlphaZero 在围棋中从零开始自我对弈、自发发现人类棋手未曾使用过的招法,有着深刻的相似性。

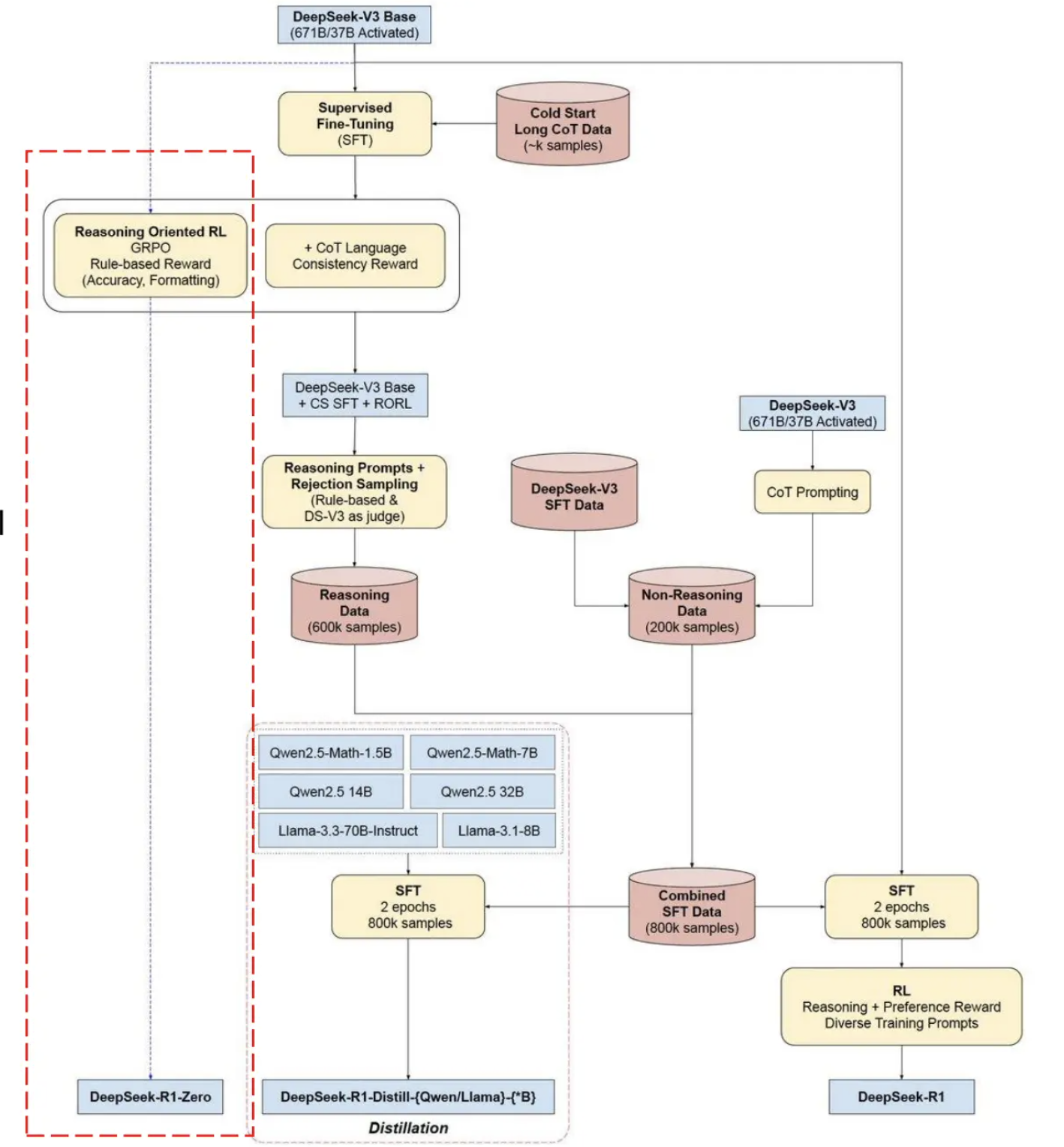

17.0.6 从 R1-Zero 到完整推理模型

纯 RLVR 训练的 R1-Zero 虽然在数学和编程上表现出色,但在通用任务上存在明显问题:思维链语言混杂、思考过程混沌不可读、无法应付日常对话。因此,DeepSeek 设计了一套完整的四阶段训练流程来产出最终的 DeepSeek-R1:

图 17-9:从基座模型到 DeepSeek-R1 的完整训练流程。包括冷启动 SFT、推理 RL、拒绝采样 SFT 和通用 RL 四个阶段。

这条从"书呆子"(仅擅长解题的 R1-Zero)到"全面发展"(通用推理模型 R1)的路径,为整个行业树立了推理模型训练的标准范式。

17.0.7 两种 Scaling 范式的统一视角

至此,我们可以清晰地看到大模型领域正在经历的范式转换。两种 Scaling 方式构成了提升模型能力的双引擎:

| 维度 | 预训练 Scaling(Train-Time) | 推理 Scaling(Test-Time) |

|---|---|---|

| 核心思想 | 增加训练阶段的计算量 | 增加推理阶段的计算量 |

| 扩展手段 | 更大模型 + 更多数据 + 更长训练 | 更长思维链 + 搜索 + 自我验证 |

| 收益模式 | 幂律递减(Loss ∝ | 随问题难度自适应 |

| 瓶颈 | 数据墙、算力墙 | 奖励设计、搜索空间 |

| 代表工作 | GPT-3、Chinchilla、Llama 3 | OpenAI o1、DeepSeek-R1 |

表 17-2:两种 Scaling 范式的对比。

推理模型的关键洞察在于:模型能力 = 预训练能力 × 推理时的计算投入。一个经过良好预训练的基座模型,通过在推理阶段投入更多计算来"深度思考",可以解决远超其"直觉"能力范围的问题。这就好比人类面对一道困难的数学题——聪明的头脑(预训练能力)是基础,但充足的思考时间(推理计算)同样不可或缺。

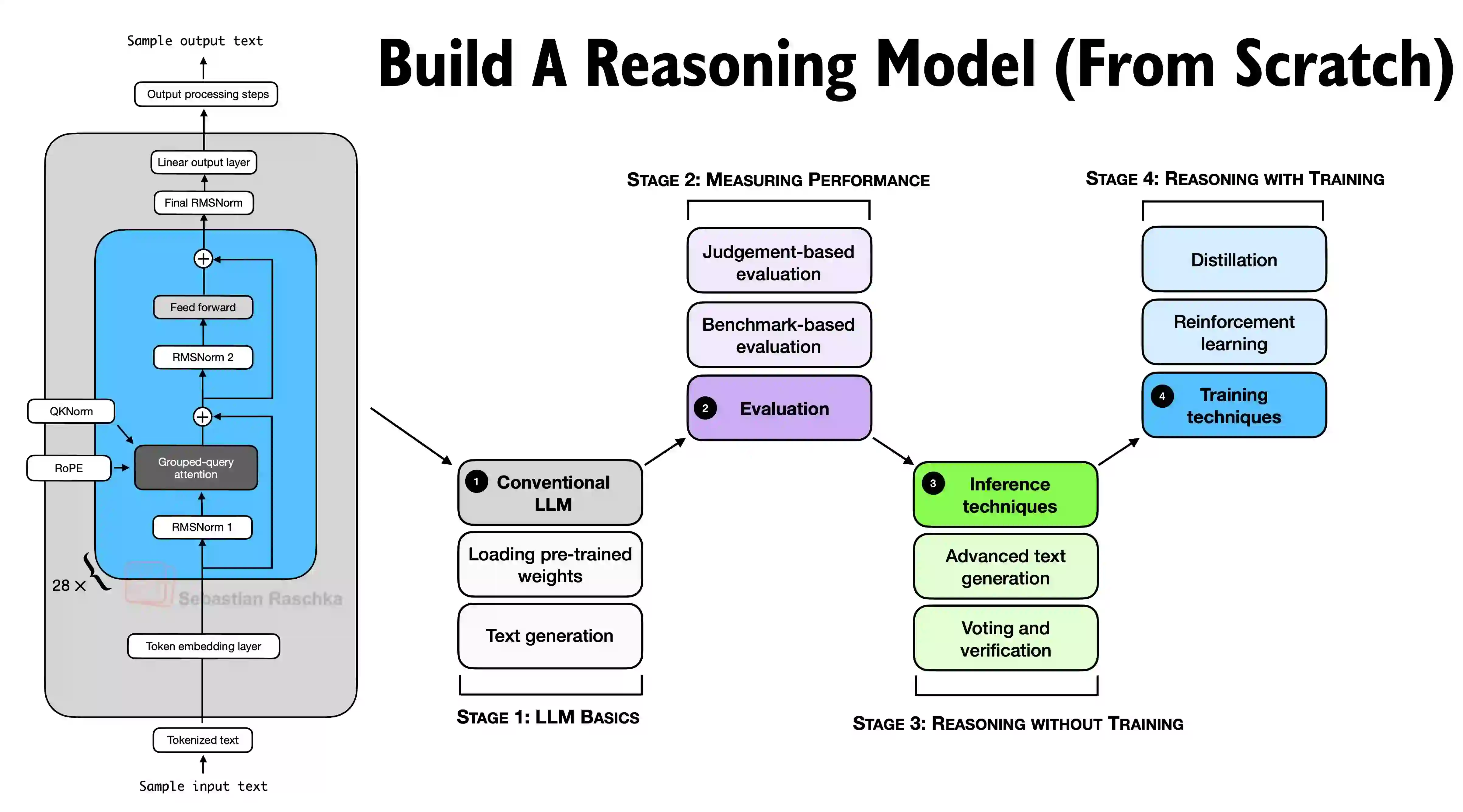

图 17-10:推理模型技术全景图。从预训练基座出发,通过推理时扩展(Inference-Time Scaling)、强化学习(RL)和蒸馏(Distillation)三条路径构建完整的推理能力。

DeepSeek-R1 的成功发布引发了推理模型的行业浪潮。此后各大厂商纷纷推出自己的推理模型:OpenAI 发布了 o3 和 GPT-5,Google 推出 Gemini 2.5 Pro,Anthropic 发布 Claude 4 系列,阿里巴巴推出 Qwen3 系列——深度推理已经成为大模型发展的新主线。

本节小结

本节梳理了从预训练 Scaling Law 到推理模型范式的完整演进脉络。核心要点如下:

- 预训练 Scaling Law 揭示了模型性能与参数量、数据量、计算量之间的幂律关系,但这条路线正面临数据墙、算力墙和能力墙的三重挑战。

- 思维链(CoT)揭示了大模型隐藏的推理潜力,奠定了"在推理时投入更多计算"的基本思路。

- 过程奖励模型(PRM)和搜索算法提供了评估与优化推理过程的工具,但受限于标注成本和搜索空间爆炸。

- RLVR 范式(以 DeepSeek-R1-Zero 为代表)通过基于可验证奖励的强化学习,绕过了奖励模型的所有陷阱,让模型自发涌现出深度思考能力。

- 两种 Scaling 范式——预训练 Scaling 和推理 Scaling——共同构成了提升大模型能力的双引擎。

在后续章节中,我们将深入每一项关键技术的原理与实现:从 GRPO 算法的数学推导,到推理模型的完整训练流程,再到蒸馏与部署优化,逐步构建起推理模型的完整知识体系。