第26章 低代码平台与可视化构建

本章来源:综合自 Hello-Agents 第五章(低代码平台的实操与分析)、Hello-Agents Extra03(Dify操作指南)

核心问题 -- 本章要解答什么

上一章分析了代码级智能体框架的设计哲学,本章将视角转向抽象层级的另一端:低代码/无代码平台。Coze、Dify、n8n等平台将智能体的构建从"编写代码"提升到"拖拽节点",本质上是在框架之上再加一层可视化抽象。这引发了几个关键问题:

- 低代码平台的核心价值命题是什么?它解决了代码框架的哪些痛点?

- 主流平台的架构设计和定位有何差异?如何选择?

- 可视化编排的表达能力边界在哪里?何时需要"逃逸"到代码?

- 平台生态(插件市场、模型集成、发布渠道)如何影响智能体能力的上限?

设计空间 -- 可选方案与取舍

26.1 平台化构建的动机与价值

纯代码开发模式在追求工程效率的场景中面临三个结构性挑战。信息分散在终端日志中:相比在终端中打印日志进行调试,可视化平台天然提供了端到端的运行轨迹追踪,开发者能清晰看到数据在每个节点间的流动。重复造轮子的高成本:尽管可以封装可复用的Agent类,但当业务逻辑复杂时,纯代码的维护成本和开发周期急剧上升。技术门槛限制了参与范围:代码开发将产品经理、业务专家等非技术人员排除在智能体设计之外。

低代码平台的核心价值体现在四个维度:

- 降低技术门槛:将API调用、状态管理、并发控制等封装为可视化节点,非技术用户通过拖拽即可构建工作流

- 提升开发效率:项目初期快速验证想法,数小时完成原本需要数天编码的原型

- 可视化与可观测性:图形化的运行轨迹、节点间数据流、耗时分析、失败定位

- 最佳实践沉淀:内置ReAct模板、优化的知识库检索引擎、标准化的工具接入规范

关键认知:低代码平台并非要取代代码,而是提供更高层次的抽象。它让开发者从底层实现中解放出来,更专注于智能体"思考"与"行动"的逻辑设计。

26.2 主流平台的定位光谱

当前智能体低代码平台形成了一个从"零代码消费级"到"开发者生产级"的定位光谱:

| 平台 | 核心定位 | 目标用户 | 关键优势 | 关键局限 |

|---|---|---|---|---|

| Coze | 零代码Agent构建 | 入门用户/创作者 | 插件生态丰富、多平台发布 | 不支持MCP |

| Dify | 开源LLMOps平台 | 技术开发者/企业 | 开源可控、全流程支持 | 部署有一定门槛 |

| n8n | 工作流自动化工具 | 自动化工程师 | 通用连接能力、数百个预置节点 | LLM专一度不如前两者 |

架构解析 -- 深入分析主流平台

26.3 Coze:消费级智能体工厂

Coze(扣子)由字节跳动推出,主打零代码/低代码的Agent构建体验。其设计哲学可以用一个类比概括:构建智能体就像打游戏。

功能模块架构

Coze的功能模块按"游戏"隐喻组织:

- 工作流:关卡通关路线图 -- 定义智能体的执行逻辑

- 对话流:NPC对话通关 -- 设计多轮对话交互

- 插件:角色技能卡 -- 扩展智能体的外部能力

- 知识库:游戏百科全书 -- 为智能体提供领域知识

- 卡片:快捷道具栏 -- 预设的交互模板

- 提示词:角色的控制键 -- 定义智能体行为的核心

- 数据库:云存档 -- 持久化存储

- 发布管理:关卡审核员 -- 多渠道分发

创建模式。Coze提供两类AI应用入口:智能体(单智能体自主规划、单智能体对话流、多智能体)和AI应用(桌面网页端UI、小程序/H5端UI)。这种分类体现了从"对话式"到"应用式"的双轨策略。

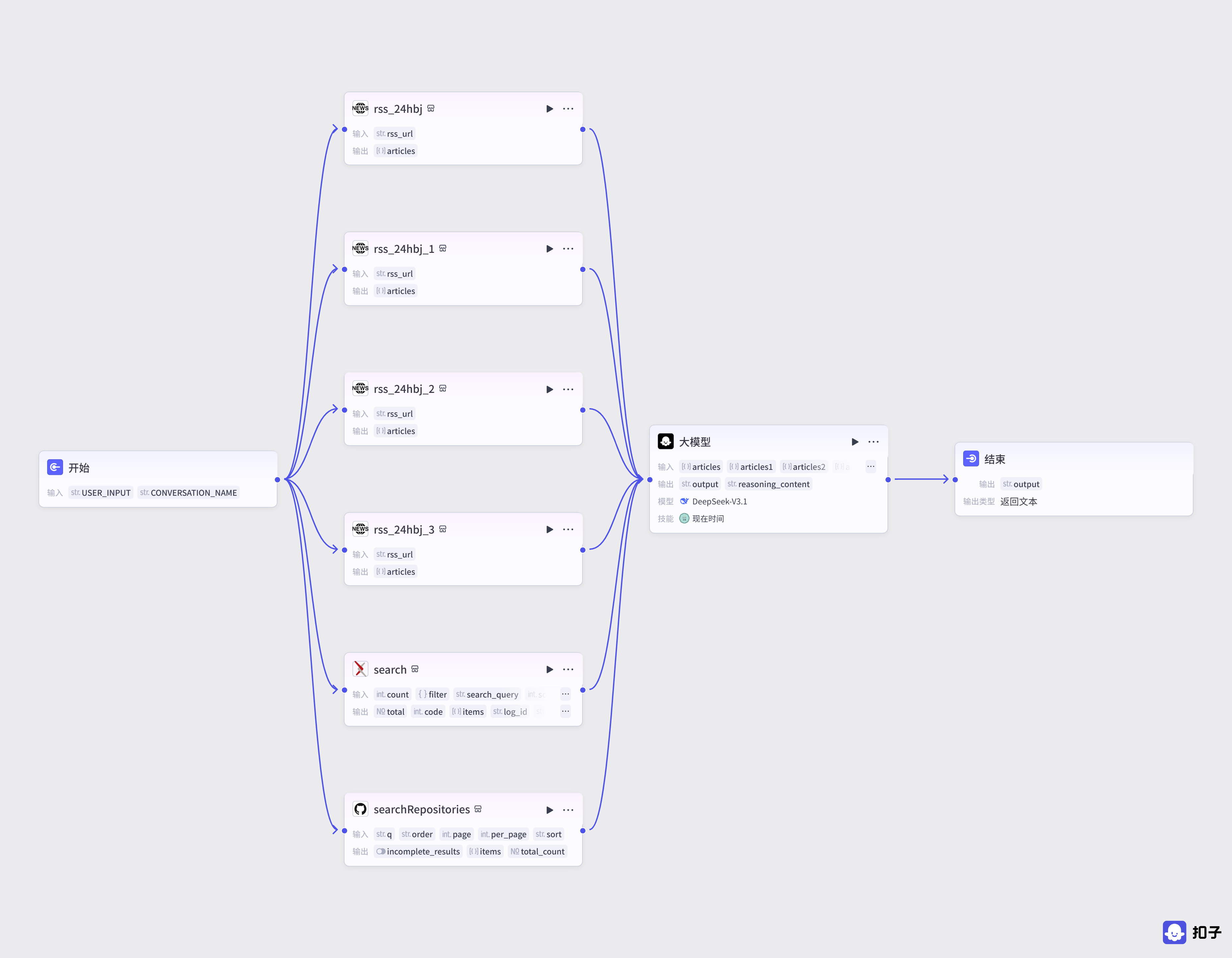

案例分析:"每日AI简报"智能体

以构建"每日AI简报"为例,展示Coze的典型工作流:

第一步是多源信息接入。通过RSS插件订阅36氪、虎嗅等媒体平台,GitHub插件追踪开源项目动态,arXiv插件获取最新学术论文。每个插件都需要精细化配置——RSS需要输入订阅链接,GitHub需要设置关键词和排序方式,arXiv需要定义领域关键词。

第二步是角色与提示词设计。将智能体设定为"资深科技媒体编辑",系统提示词定义长期行为准则和输出格式(日报标题格式、Emoji标注规则、内容过滤标准),用户提示词定义具体任务指令(从哪些数据源提取什么内容、整理成什么模块)。

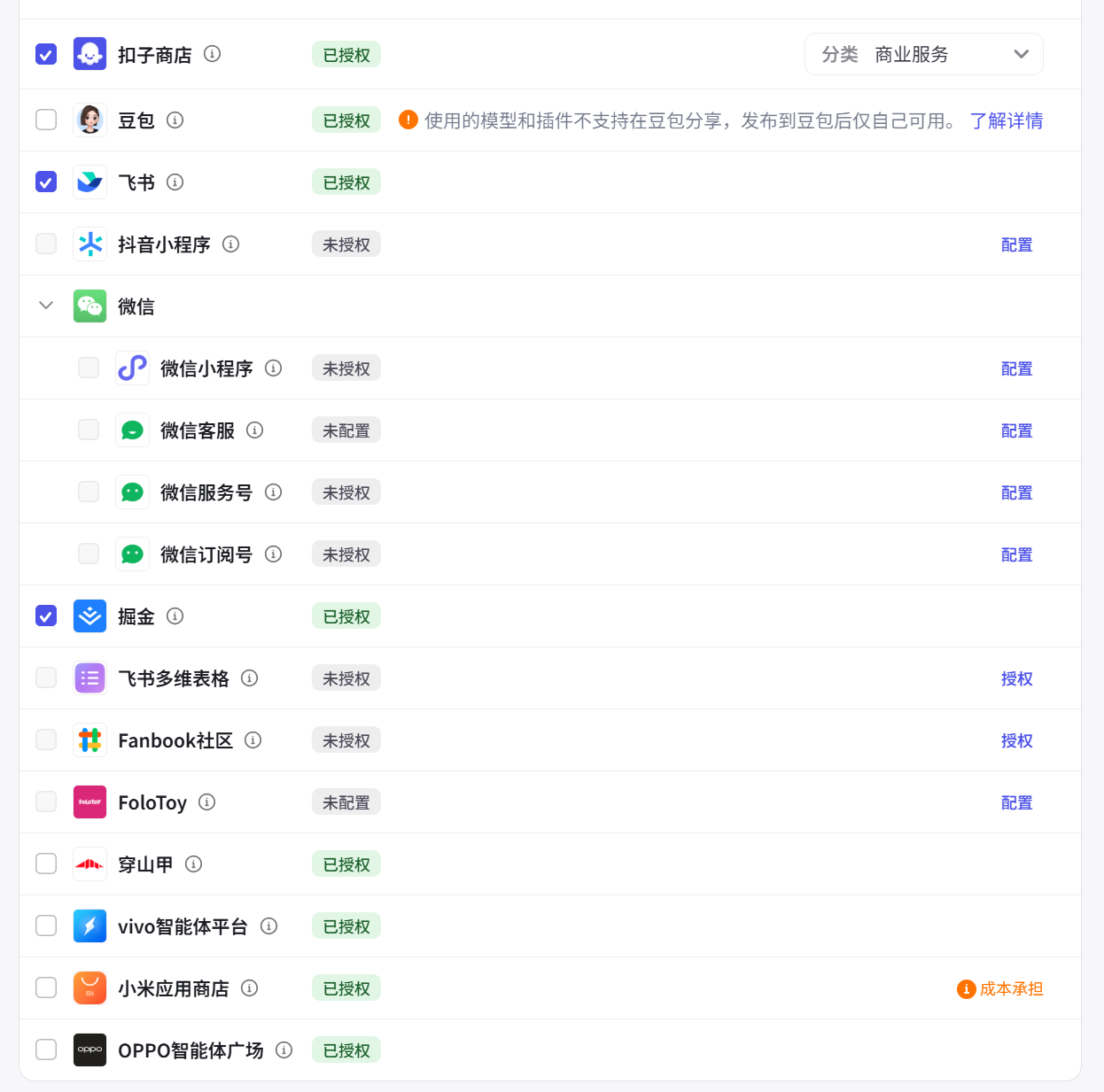

第三步是多渠道发布。Coze支持一键发布到微信、飞书、豆包、抖音等主流平台,配置名称、头像、欢迎语后即可上线。

优势与局限分析

Coze的核心优势在于插件生态和分发渠道:丰富的插件库使得快速接入外部服务变得简单,多平台一键发布极大简化了分发流程。但其最大短板是不支持MCP协议——这意味着无法接入标准化的工具生态,可能成为限制长期发展的瓶颈。此外,复杂工作流仍需JavaScript或Python基础,编排文件不支持标准JSON格式的导入导出。

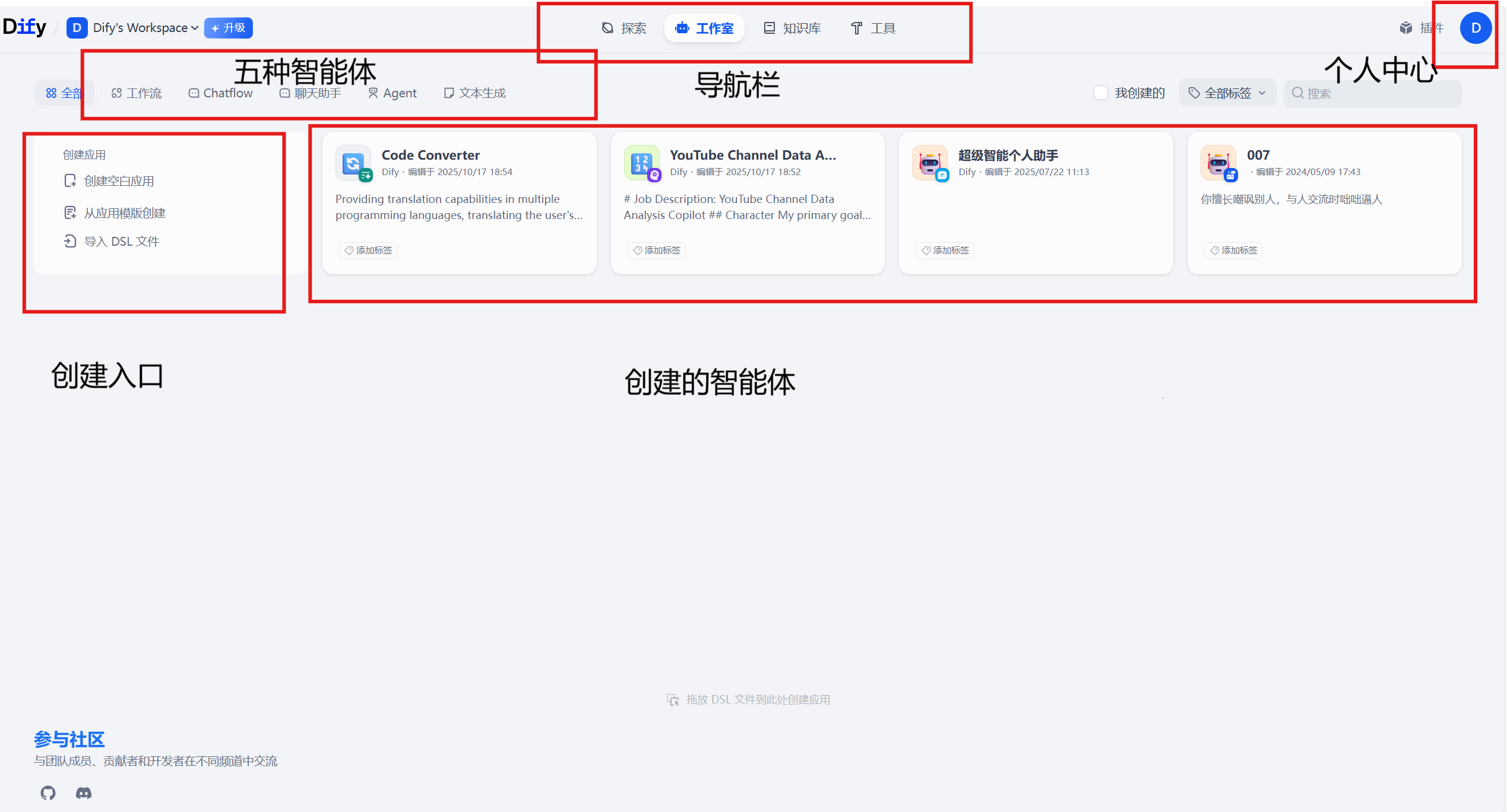

26.4 Dify:开源的LLMOps平台

Dify是一个开源的LLM应用开发与运营平台,融合了BaaS(后端即服务)和LLMOps理念,定位为从原型设计到生产部署的一站式解决方案。

架构设计

Dify采用分层模块化架构:数据层、开发层、编排层和基础层各层解耦,便于扩展。其核心设计特征:

- 模型中立:无论开源或商业模型,都可通过统一接口接入。内置支持GPT、DeepSeek、Llama等数百种模型

- 部署灵活:官方提供Docker Compose一键启动的本地部署,也提供SaaS云服务

- MCP原生支持:与标准化工具生态完全兼容,支持SSE通信模式

Marketplace插件生态

截至 2025 年初,Dify 在 GitHub 上已获得超过 80K Star,成为最受欢迎的开源 LLMOps 平台之一。Dify的插件市场已超过8600个插件,涵盖模型(Models)、工具(Tools)、智能体策略(Agent Strategies)、扩展(Extensions)和捆绑包(Bundles)。关键优势在于为插件开发者提供了远程调试功能,可与IDE无缝协作——这种开发者友好的策略是Dify生态繁荣的重要原因。

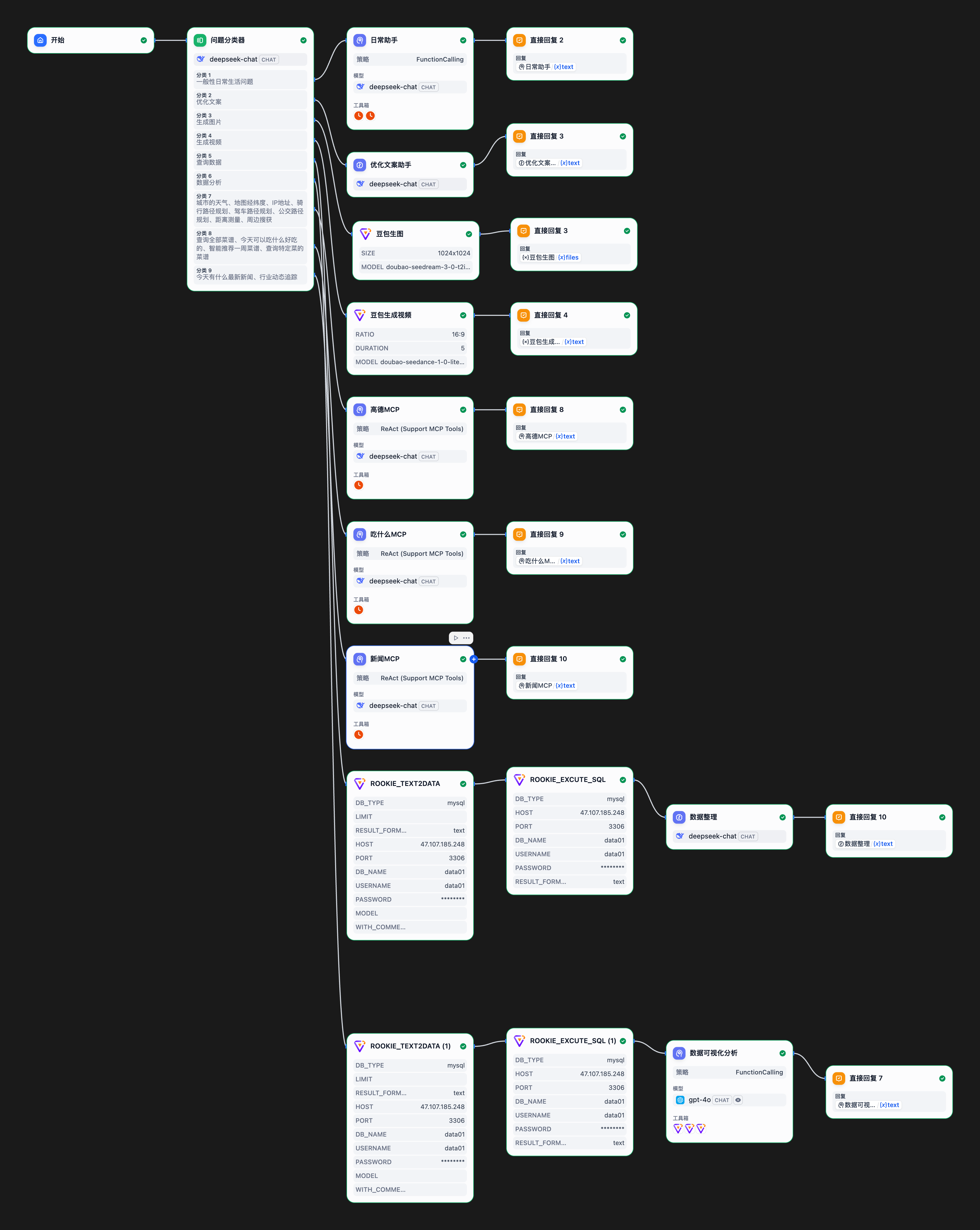

案例分析:超级智能体个人助手

Dify平台上的"超级智能体个人助手"案例展示了更复杂的架构设计:

系统使用问题分类器进行智能路由,将用户请求分发到不同处理模块:日常问答、文案润色、多模态生成(图片/视频)、数据查询与可视化、MCP工具集成(高德地图、饮食推荐、新闻资讯)。每个模块作为独立的智能体,配置不同的LLM、工具集和提示词。

MCP的集成方式值得关注:通过魔搭社区MCP市场,选择hosted类型服务,以SSE模式生成配置JSON,即可在Dify中使用外部工具。这种标准化的工具接入方式大大降低了集成成本。

26.5 n8n:通用工作流自动化的AI扩展

n8n的定位与Coze和Dify本质不同——它首先是一个通用工作流自动化工具,其次才是AI平台。n8n的核心优势在于"连接":拥有数百个预置节点,可以将各类SaaS服务、数据库、API连接成复杂的自动化业务流程。AI能力是嵌入这个流程中的一环。

这种定位意味着n8n最适合的场景是:需要将AI能力深度整合进现有业务流程的企业用户。例如,"收到客户邮件 -> AI分析意图 -> 查询CRM -> 生成回复 -> 发送邮件 -> 更新工单"这样的跨系统自动化,n8n比纯AI平台更擅长。

其局限在于学习曲线较陡峭,LLM专一度不如Coze和Dify。

关键实现决策 -- 工程实践中的关键选择点

26.6 可视化编排的表达能力边界

可视化编排不是万能的。理解其边界,有助于在正确的场景使用正确的工具。

适合可视化编排的场景:

- 线性或分支工作流:数据从输入经过一系列处理步骤到达输出

- 工具编排:串联多个API调用,处理结果合并

- 原型验证:快速验证一个智能体想法是否可行

- 非技术协作:产品经理和开发者共同设计智能体逻辑

需要"逃逸"到代码的场景:

- 复杂状态管理:需要维护跨轮对话的复杂状态结构

- 自定义推理逻辑:超出平台预设模式的推理策略

- 性能优化:需要精细控制并发、缓存、重试等工程细节

- 深度集成:需要与特定系统进行深度、非标准化的集成

多数平台都提供了"代码节点"作为逃逸机制——在可视化流程中嵌入自定义代码片段。但这种方式的调试体验通常不如纯代码环境。

26.7 平台选型决策矩阵

| 决策维度 | Coze | Dify | n8n |

|---|---|---|---|

| 技术门槛 | 最低 | 中等 | 较高 |

| 自定义深度 | 有限 | 较深 | 最深 |

| 部署选项 | 仅云端 | 云端+本地 | 云端+本地 |

| MCP支持 | 不支持 | 原生支持 | 部分支持 |

| 插件生态 | 极丰富(封闭) | 丰富(开放) | 通用连接器 |

| 发布渠道 | 多平台一键发布 | API为主 | 自定义集成 |

| 适用场景 | 快速创建面向C端的智能体 | 企业级AI应用开发 | 跨系统业务自动化 |

| 开源性 | 闭源 | 开源 | 开源 |

选型建议:

- 个人创作者/快速验证 -> Coze

- 技术团队/企业级应用 -> Dify

- 已有复杂IT系统需要AI增强 -> n8n

- 需要数据主权/本地部署 -> Dify或n8n

26.8 从低代码到生产级的迁移路径

一个常见的开发路径是:低代码平台验证 -> 代码框架实现 -> 生产级部署。这个迁移过程的关键挑战:

逻辑迁移:可视化工作流到代码的翻译通常不是自动的。Dify支持JSON格式的导出,可以作为迁移的起点;Coze的导出格式是专有的zip包,迁移成本更高。

状态管理升级:低代码平台通常隐式管理状态,迁移到代码框架时需要显式设计状态结构和持久化策略。

可观测性保持:平台提供的可视化调试在迁移后需要通过日志框架、分布式追踪等工程手段重建。

前沿动态 -- 学术界/工业界最新进展

AI应用构建器的融合趋势。Coze正在从纯智能体平台扩展为AI应用平台(支持UI设计),Dify在强化其LLMOps能力(模型管理、效果评测),n8n在深化AI节点能力。三者都在向"全栈AI应用构建器"收敛。

MCP生态的平台化。MCP协议的标准化使得工具生态开始跨平台复用。Dify率先集成MCP支持获得了先发优势,其他平台正在跟进。未来"工具即服务"的模式可能改变平台竞争格局。

Agent as App的范式转变。从"对话式智能体"到"应用式智能体"的转变正在发生。Coze支持创建带有完整UI的AI应用,Dify的"工作流"模式允许构建非对话式的自动化流程。这意味着低代码平台正在从"聊天机器人构建器"演变为"AI应用构建器"。

本地化与数据主权。企业客户对数据主权的要求推动了本地部署能力的重要性。Dify的Docker一键部署和n8n的自托管选项在企业市场具有明显优势。

⚠️ 已知局限:低代码平台的核心局限是**"80/20 陷阱"**——80% 的常规需求可以通过可视化编排高效实现,但剩余 20% 的定制需求可能消耗 80% 的开发时间。当可视化节点无法表达复杂逻辑时,开发者被迫在"代码节点"中嵌入大段代码,这些代码片段缺乏 IDE 的完整调试支持(断点、类型检查、代码补全),调试体验远逊于纯代码开发。此外,平台锁定(vendor lock-in)是实际部署中的关键风险:Coze 的闭源架构和专有导出格式使迁移成本极高,即使是开源的 Dify,其编排 DSL 也没有跨平台标准,工作流无法直接迁移到 n8n 或代码框架中。性能层面,可视化编排引入的解释层开销在高并发场景下可导致 30-50% 的额外延迟。

本章小结

低代码平台代表了智能体构建的"民主化"方向——通过可视化抽象降低技术门槛,使更广泛的人群能够参与AI应用的设计与创造。Coze以其极低的门槛和丰富的分发渠道服务个人创作者,Dify以其开源特性和全流程能力服务技术团队,n8n以其通用连接能力服务企业自动化需求。

然而,低代码平台不是代码框架的替代品,而是补充。理解可视化编排的表达能力边界,掌握从平台到代码的迁移路径,这些是在快速变化的工具生态中保持灵活性的关键。最终,工具的选择应服务于目标:如果目标是快速验证想法,选择门槛最低的平台;如果目标是构建可控的生产系统,选择提供足够控制力的框架。